Mac bilgisayarınıza en yeni Büyük Dil Modellerini (LLM'ler) yerel olarak nasıl yükleyebilirsiniz?

Son yıllarda, büyük dil modelleri (LLM'ler), insan benzeri metin üretme ve çeşitli görevlerde yardımcı olma yetenekleri nedeniyle giderek daha popüler hale geldi. Tüm modeller açık kaynaklı olmasa da, neredeyse her büyük teknoloji şirketinin kullanıcıların indirip çalıştırabileceği bir sürümü mevcuttur.

Bu modelleri Mac'inizde yerel olarak çalıştırmak hem gizlilik hem de maliyet açısından faydalı olabilir. Bu makalede, LLM'leri nasıl kurup çalıştıracağımızı inceleyeceğiz. OllamaGeliştiriciler ve yeni başlayan kullanıcılar için güçlü bir araçtır ve macOS Terminalini kullanmayı tercih etmeyenler için süreci basitleştirebilecek bazı grafiksel kullanıcı arayüzü araçlarını ele alacağız.

Bu sayede [Google], [Microsoft], [Meta] ve [Mistral] ve [DeepSeek] gibi diğer yapay zeka şirketlerinin en yeni yapay zeka destekli metin şablonlarına erişebilirsiniz.

LLM'leri Anlamak: Parametreler Ne Anlama Geliyor?

Kurulum sürecine geçmeden önce, " gibi rakamların ne anlama geldiğini açıklığa kavuşturalım."7B"Ya da"14BLLM'lerden bahsederken, bu sayılar model boyutunu şu şekilde ifade eder: Parametreler (Milyarlarca) adeta eğitim sırasında hassas bir şekilde ayarlanan "kollar ve anahtarlar" olan bu mekanizmalar,

Daha fazla parametre, modelin dildeki daha karmaşık kalıpları ve ilişkileri yakalamasına olanak tanıyarak potansiyel olarak daha iyi performansa yol açabilir. Bununla birlikte, daha fazla parametreye sahip olmanın her zaman daha iyi sonuçları garanti etmediğini belirtmek önemlidir; eğitim verilerinin kalitesi ve modelin kullanımına sunulan hesaplama kaynakları da önemli roller oynar.

Sistem gereksinimleri

[Mac] bilgisayarınızın en az aşağıdaki özelliklere sahip olduğundan emin olmanız gerekecektir:

- macOS 10.15 veya üzeri (macOS 13 veya üzeri önerilir)

- En az 8 GB RAM (16 GB veya üzeri önerilir)

- 10 GB boş depolama alanı (en küçük modeller için gereken minimum miktar; daha fazla parametreye sahip daha gelişmiş modeller yaklaşık 700 GB gerektirir)

- [Intel] çok çekirdekli işlemci veya [Apple Silicon] işlemci (M2 veya üzeri tercih edilir)

Ollama'yı yükle

Ollama Bu, LLM'leri doğrudan yerel makinenizde çalıştırmanıza olanak tanıyan açık kaynaklı bir araçtır. İşte nasıl başlayacağınız:

- Ollama'yı İndir: Web sitesini ziyaret edin Ollama macOS sürümünü indirin. Ayrıca [Homebrew] kullanarak da yükleyebilirsiniz.

brew install ollamaTerminalinizde.

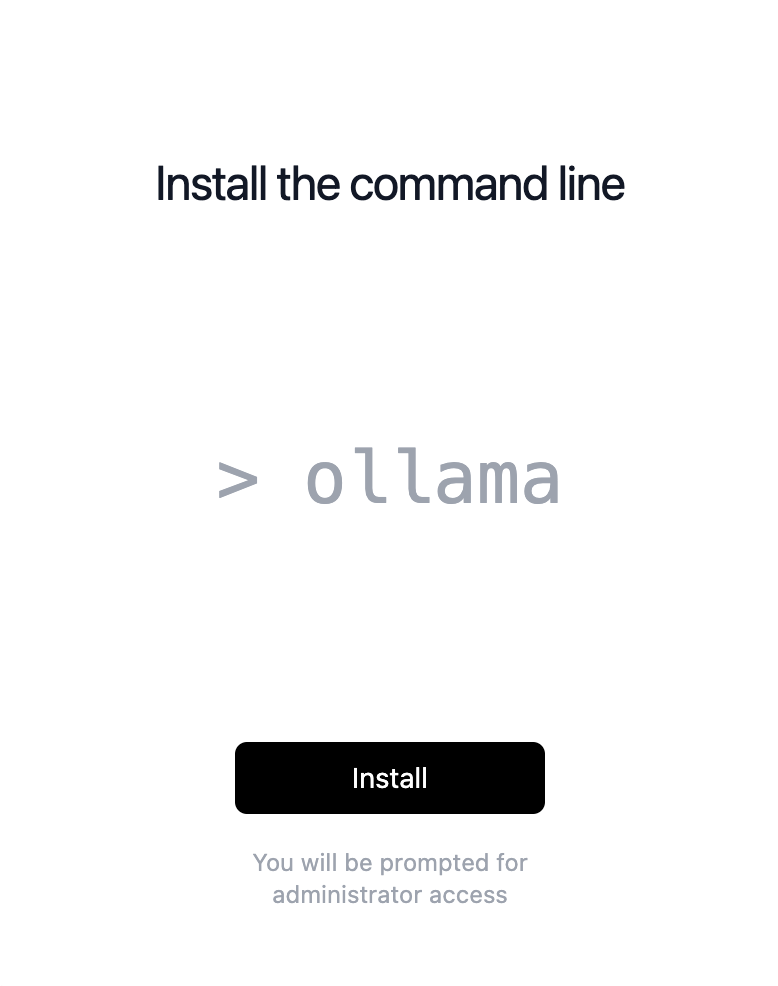

- Ollama'yı yükleKurulum dosyasını indirdiyseniz, çift tıklayın ve kurulum sihirbazını takip edin. Homebrew kullanıyorsanız, 4. adıma geçin.

- Kurulum programının bir sonraki adımı, düğmeye tıklamaktır. تثبيتBu işlem sizden yönetici parolanızı isteyecektir.

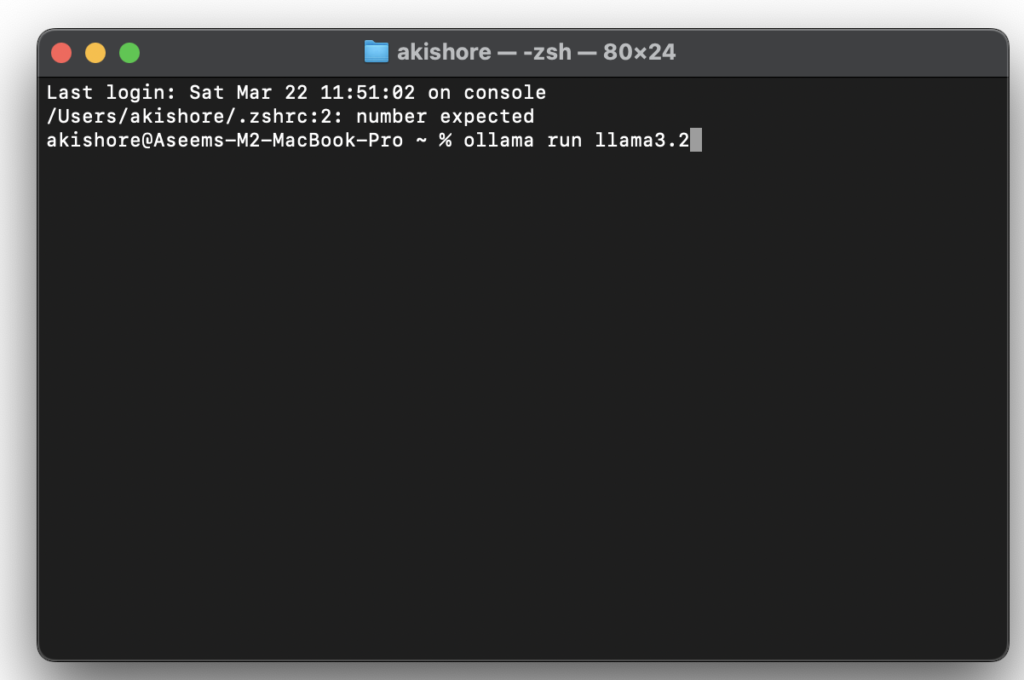

- Ollama'yı çalıştırBir terminal penceresi açın ve aşağıdaki komutu kullanarak Ollama'yı bir servis olarak başlatın.

brew services start ollamaBu sayede Ollama belirtilen adreste kullanılabilir hale gelecek.http://localhost:11434/. - Modeli indirin ve çalıştırın.Komutu kullanın

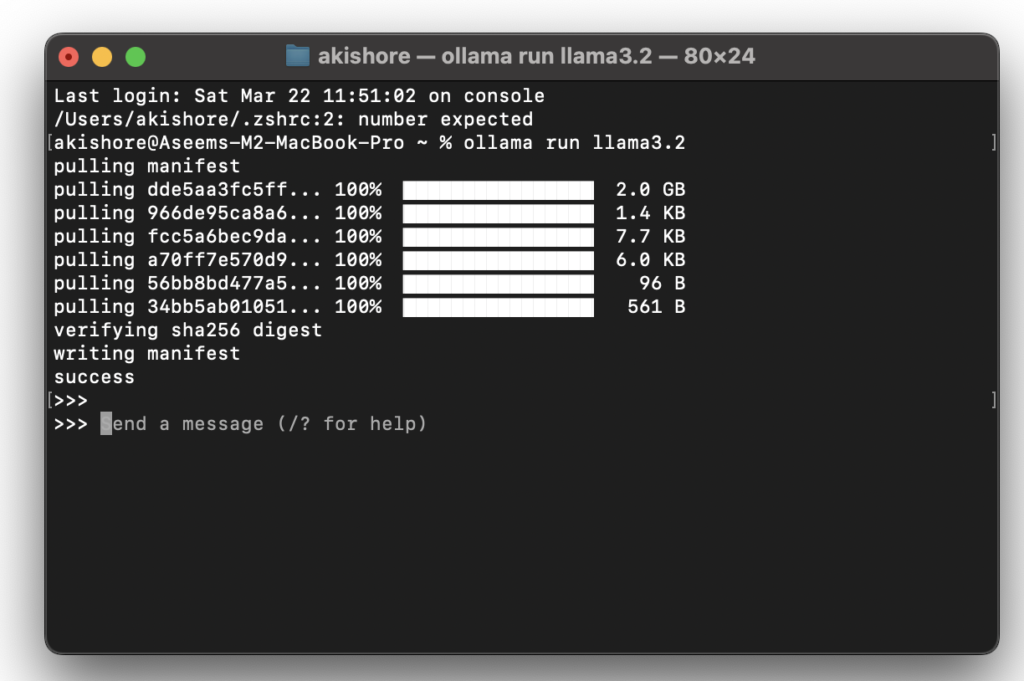

ollama pull <model-name>Şablonu indirmek için şu komutu kullanın.ollama run <model-name>Çalıştırmak için. Örneğin, bir modeli çalıştırmak için. DeepSeek-R1komutu kullanınollama pull deepseek-r1Ardından gelen emirollama run deepseek-r1. - Şablonun daha büyük bir sürümünü indirmek için, iki dikey nokta ve ardından boyutu eklemeniz yeterlidir. Örneğin, bir şablon indirmek için... 14B DeepSeekKomutu kullanacaksınız. ollama run deepseek-r1:14bOllama web sitesinde, formlardan herhangi birine tıklarsanız, her sürüm için farklı komutların tümü size gösterilecektir.

Tam listeyi burada bulabilirsiniz. Ollama modelleri İşte burada. Yukarıda açıklandığı gibi ikinci komutu da kullanabilirsiniz ve eğer henüz kurulu değilse, önce formu indirecek ve ardından çalıştıracaktır.

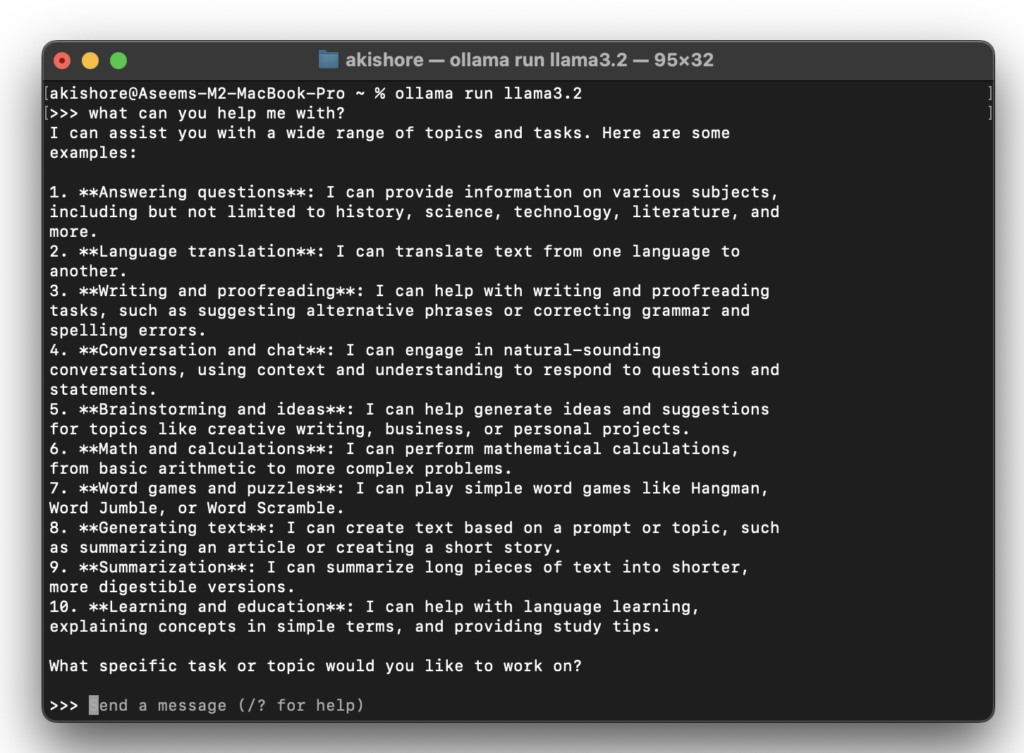

Şimdi üç dik açılı oku (>>>) gördüğünüze göre, forma komutlar yazmaya başlayabilirsiniz.

İşte bu kadar! Artık maliyetler, aşırı kullanım veya başkalarının yazdıklarınızı okuyabilmesi konusunda endişelenmeden yapay zekâ destekli öğrenme modelinizle yerel olarak etkileşim kurabilirsiniz. Bu, yapay zekâ destekli öğrenme modeliyle tartışmak istediğiniz hassas veya kişisel konularınız varsa ancak büyük bir teknoloji şirketinin düşüncelerinizi okumasını istemiyorsanız harika bir özellik.

Ollama ile grafiksel kullanıcı arayüzü araçlarını kullanma

Ollama geliştiriciler için güçlü ve verimli olsa da, bazı kullanıcılar LLM'lerle etkileşim kurmak için grafiksel bir kullanıcı arayüzünü (GUI) tercih edebilir. İşte Ollama için bir GUI ön yüzü sağlayabilecek bazı araçlar:

-

-

- Ollama GUIBu, SwiftUI kullanılarak geliştirilmiş, macOS kullanıcıları için ücretsiz ve açık kaynaklı bir uygulamadır. Güzel bir arayüz sunar ve terminal kullanmadan LLM formlarına yerel olarak erişmek isteyenler için mükemmel bir seçenektir.

- Ollama UIBasit, HTML tabanlı bir web kullanıcı arayüzü olup, formları doğrudan tarayıcınızda tanımlamanıza ve bunlarla etkileşim kurmanıza olanak tanır. Kolay erişim için bir Chrome uzantısı da içerir.

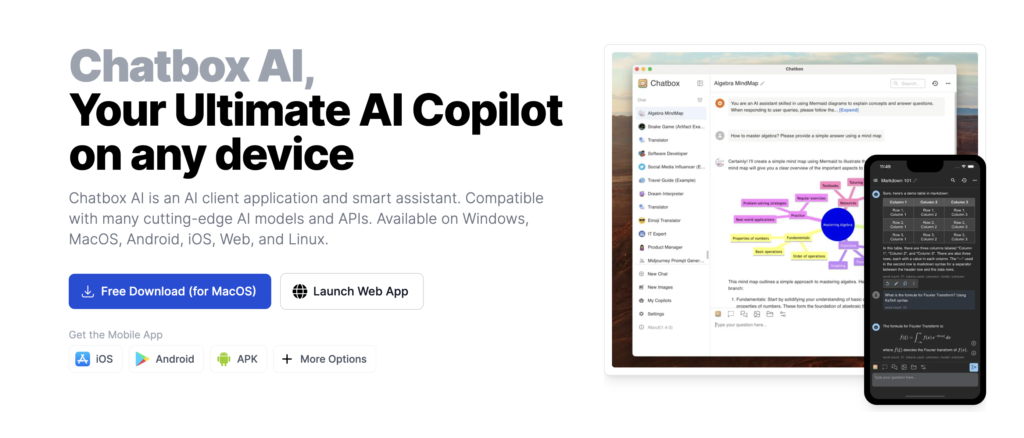

- Sohbet kutusu AIBu, yeni başlayanlar için en kolay seçenektir ve nasıl kullanılacağını aşağıda açıklayacağım. Ollama'yı kendiniz kurmak zorunda kalmadan tüm LLM şablonlarına erişebilmeniz için sundukları abonelik olan Chatbox AI hizmetini edinmenize gerek olmadığını unutmayın.

-

En iyi Chatbox yapay zeka arayüzünü kullanmak için şu adrese gidin: indirme sayfası Mac'iniz için uygun olan sürümü edinin.

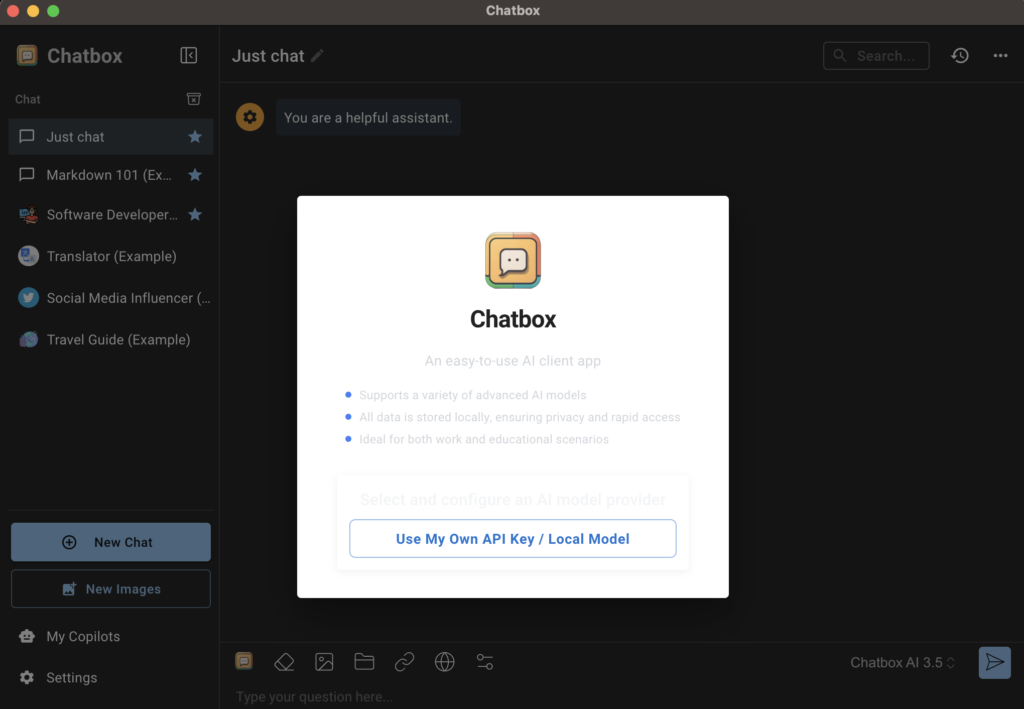

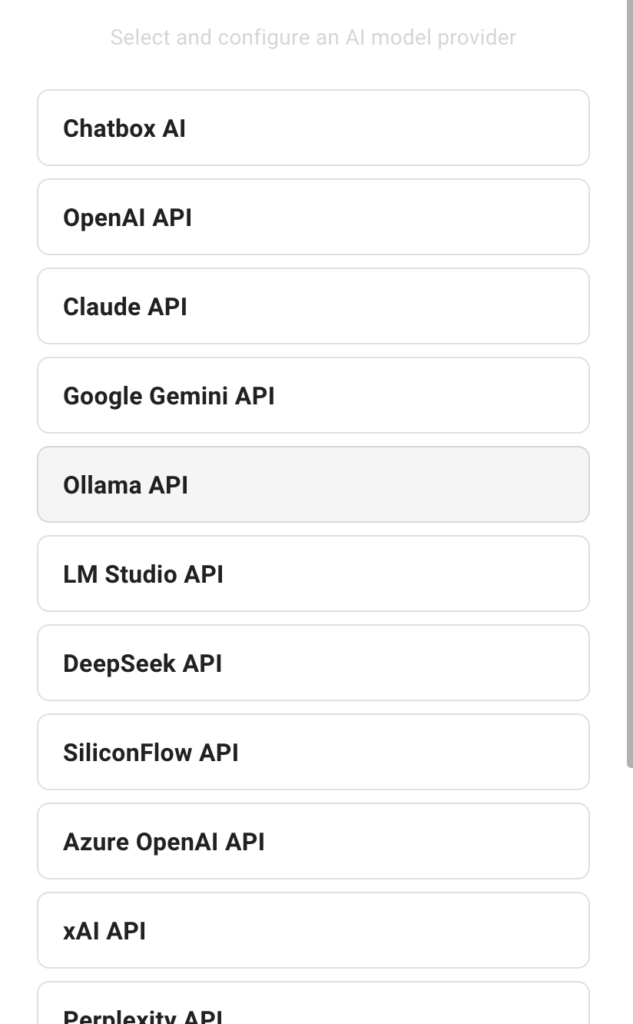

Ardından, yükleyiciyi açın ve programı çalıştırın. İlk ekranda, Chatbox AI'yı nasıl kullanacağınızı soran bir açılır pencere belirecektir.

Düğmeye tıklamanız gerekecek. Kendi API Anahtarımı Kullan / Yerel Model.

Ardından, simgesine dokunun. Ollama API Yapay zeka modelleri sağlayıcısı olarak.

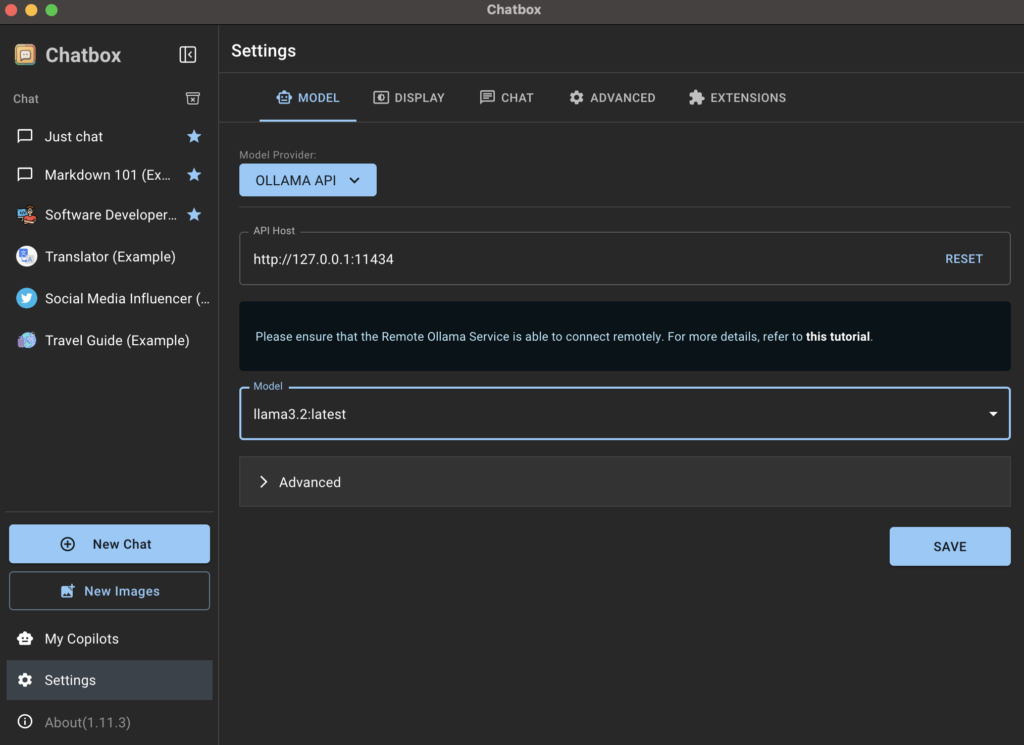

Chatbox AI, Ollama'nın çalıştığını otomatik olarak algılamalı ve API ana bilgisayarını varsayılan değerine ayarlamalıdır. Döngü Dönüş IP Adresi ve bağlantı noktası numarası 11434Burada hiçbir şeyi değiştirmenize gerek yok. Formun içinde, Terminal kullanarak daha önce yüklediğiniz formları görmelisiniz. Benim durumumda bu, şu form: lamalar 3.2.

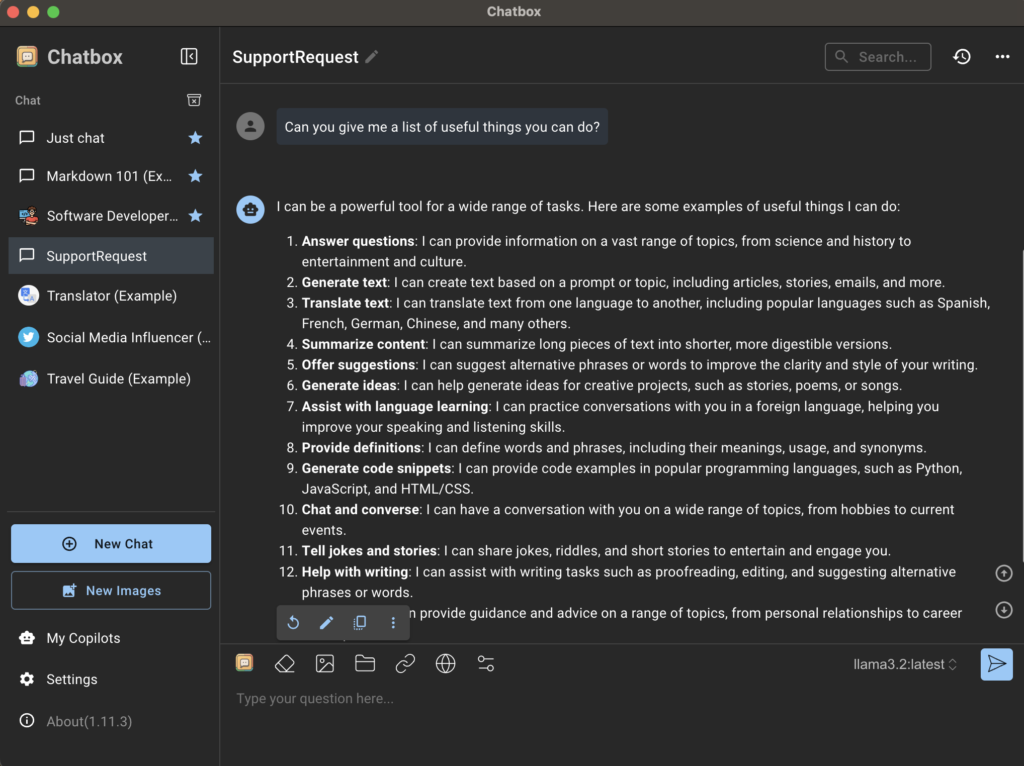

Uygulamanın ana sayfasına geri dönün ve tıklayın. Sadece sohbet أو Yeni sohbet Sağ alt köşede doğru şablonu seçtiğinizden emin olun. Şablonu istediğiniz zaman değiştirebilirsiniz, ancak farklılıkları kolayca görebilmeniz için kullandığınız her şablon için yeni bir sohbet oluşturmanızı öneririm.

LLM modellerini yerel olarak çalıştırmak için alternatif araçlar

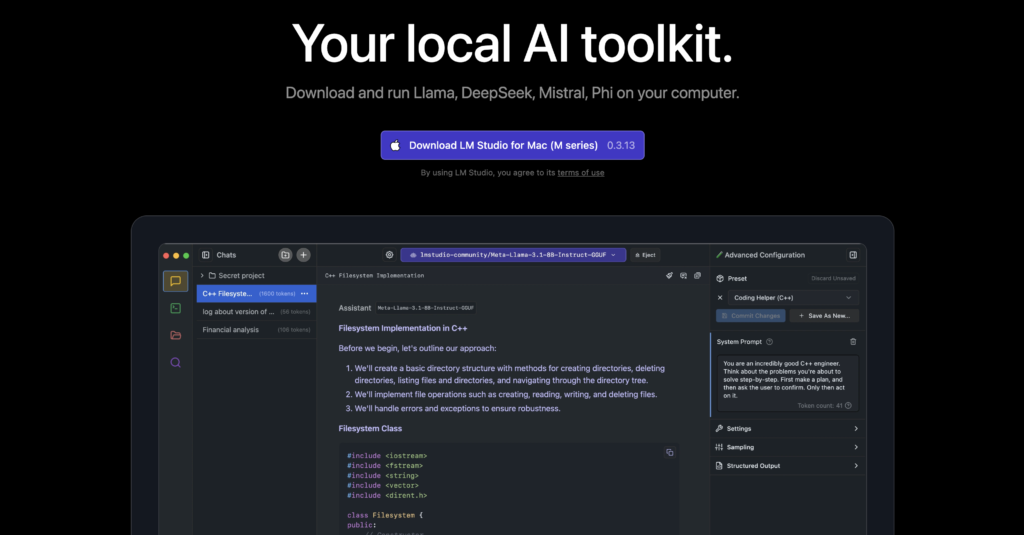

Ollama'ya alternatif arıyorsanız veya baştan itibaren daha kullanıcı dostu bir deneyim tercih ediyorsanız, o zaman LM Stüdyosu Bu da mükemmel bir seçenek. Çeşitli yapay zeka modellerini keşfetmek ve kullanmak için kullanıcı dostu bir arayüz sunuyor ve bunları kolayca indirip çalıştırmanıza olanak tanıyor. LM Studio, Linux, Mac ve Windows için mevcut olup model parametrelerini ve sohbet geçmişini özelleştirme gibi özellikler sunuyor. Şu anda ücretsiz olduğu için Chatbox AI abonelik hizmetine göre bunu tavsiye ediyorum.

Sonuç

Mac'inizde büyük dil modellerini (LLM'ler) yerel olarak çalıştırmak, yapay zeka uygulamaları üzerinde daha fazla kontrol sahibi olmak ve veri gizliliğine öncelik vermek isteyen herkes için önemli olacaktır. Ollama ve yukarıda bahsedilen, LLM'leri iş akışınıza entegre etmeyi kolaylaştıran grafiksel arayüzler gibi araçlarla, yeni üretkenlik ve yaratıcılık potansiyelinin kilidini güvenli bir şekilde açabilirsiniz.

Ancak, yerel bir LLM dağıtımı başlatmak, parametreler ve bunların belirli makinenizde bu modellerin performansını nasıl etkilediği konusunda biraz bilgi sahibi olmayı gerektirir. Bunu öğrenmenin en iyi yolu, hangi modellerin size en iyi sonuçları verdiğini görmek için farklı modellerle denemeler yapmaktır. Bu kavramı anladığınızda, hangi modelleri kullanacağınıza ve performanslarını özel ihtiyaçlarınıza uyacak şekilde nasıl optimize edeceğinize dair daha iyi kararlar verebileceksiniz.

Yoruma kapalı.