Windows 11 bilgisayarınızda büyük dil modelleri (LLM'ler) çalıştırmak için Ollama nasıl kurulur ve kullanılır

Büyük dil modellerini (LLM) Windows makinenizde yerel olarak çalıştırmanın birden fazla yolu vardır ve Ollama bunlardan en basit ve en verimli olanıdır.

Çoğumuzun şu anda yapay zeka ile en yaygın etkileşimi bulut tabanlı araçlar aracılığıyla gerçekleşiyor. ChatGPT أو Yardımcı pilotBu araçları kullanmak için internet bağlantısına ihtiyacınız var, ancak bunun karşılığında hemen hemen her cihazda kullanabilirsiniz.

Ancak herkes, özellikle geliştiriciler, AI uygulamaları için buluta güvenmek istemez. Bu nedenle, büyük dil modelinizin (LLM) makinenizde yerel olarak çalışmasını istersiniz. İşte Ollama'nın devreye girdiği yer burasıdır.

Ollama, bilgisayarınızda yerel olarak çok çeşitli büyük dil modelleri (LLM) çalıştırmanıza olanak tanıyan bir çıkarım aracıdır. Bunu yapabileceğiniz tek yol bu değildir, ancak en basit ve en anlaşılır olanlardan biridir. Ollama, sürekli bir internet bağlantısı gerektirmeden yapay zekanın gücünden yararlanmanızı sağlayarak verileriniz ve gizliliğiniz üzerinde tam kontrol sahibi olmanızı sağlar.

Çalışır duruma geldiğinizde Ollama ve kullandığı büyük dil modelleri (LLM'ler) ile yapabileceğiniz çok şey var, ancak ilk adım kurulumdur. Bu güçlü araçtan en iyi şekilde yararlanabilmeniz için sizi bu süreçte adım adım yönlendirelim.

Ollama Sistem Gereksinimleri

Ollama'yı çalıştırmak çok fazla sistem kaynağı tüketmez ve çok çeşitli cihazlarda çalıştırılabilir. Windows 11, macOS ve Linux ile uyumludur. Hatta WSL aracılığıyla Windows 11 içindeki Linux dağıtımlarınızdan bile kullanabilirsiniz.

Ancak büyük dil modellerini (LLM'ler) çalıştırmak daha güçlü donanım gerektirir. Model ne kadar büyükse, o kadar fazla işlem gücüne ihtiyacınız olur. Bu modeller çalışmak için bir grafik işleme birimi (GPU) gerektirir. Şu anda, yeni Copilot+ PC'lerdeki sinirsel işleme birimi (NPU) için optimize edilmemiştir.

Neyse ki, mütevazı donanımlarda kullanabileceğiniz küçük modeller var. Örneğin, Google'ın Gemma 3 modeli, tam modeli çalıştırmak için yalnızca 1 GB görsel rastgele erişim belleği (VRAM) gerektiren 2.3 milyar parametreli bir modele sahiptir. 9 milyar parametreli modele geçtiğinizde bu sayı 4 GB'ın üzerine çıkar.

Meta'nın Llama 3.2'sinde de benzer bir durum var, 1 milyar parametre modelinin başarılı bir şekilde çalışması için sadece 4 GB VRAM'li bir GPU gerekiyor. Bu daha sonra 8 milyar parametre modeli için 3 GB'a çıkıyor.

Kısacası, en az 8 GB RAM ve özel bir GPU'ya sahip nispeten modern bir bilgisayarınız varsa, Ollama'yı kullanarak bazı avantajlar elde edebilmelisiniz.

Windows 11'de Ollama Kurulum Kılavuzu

Ollama'yı Windows 11'e yüklemek, indirme bölümünde özetlenen çok kolay bir işlemdir. Programı resmi web sitesinden yükleyin Veya dan GitHub deposu, ardından cihazınıza yükleyin.

Bunlar basit adımlardır.

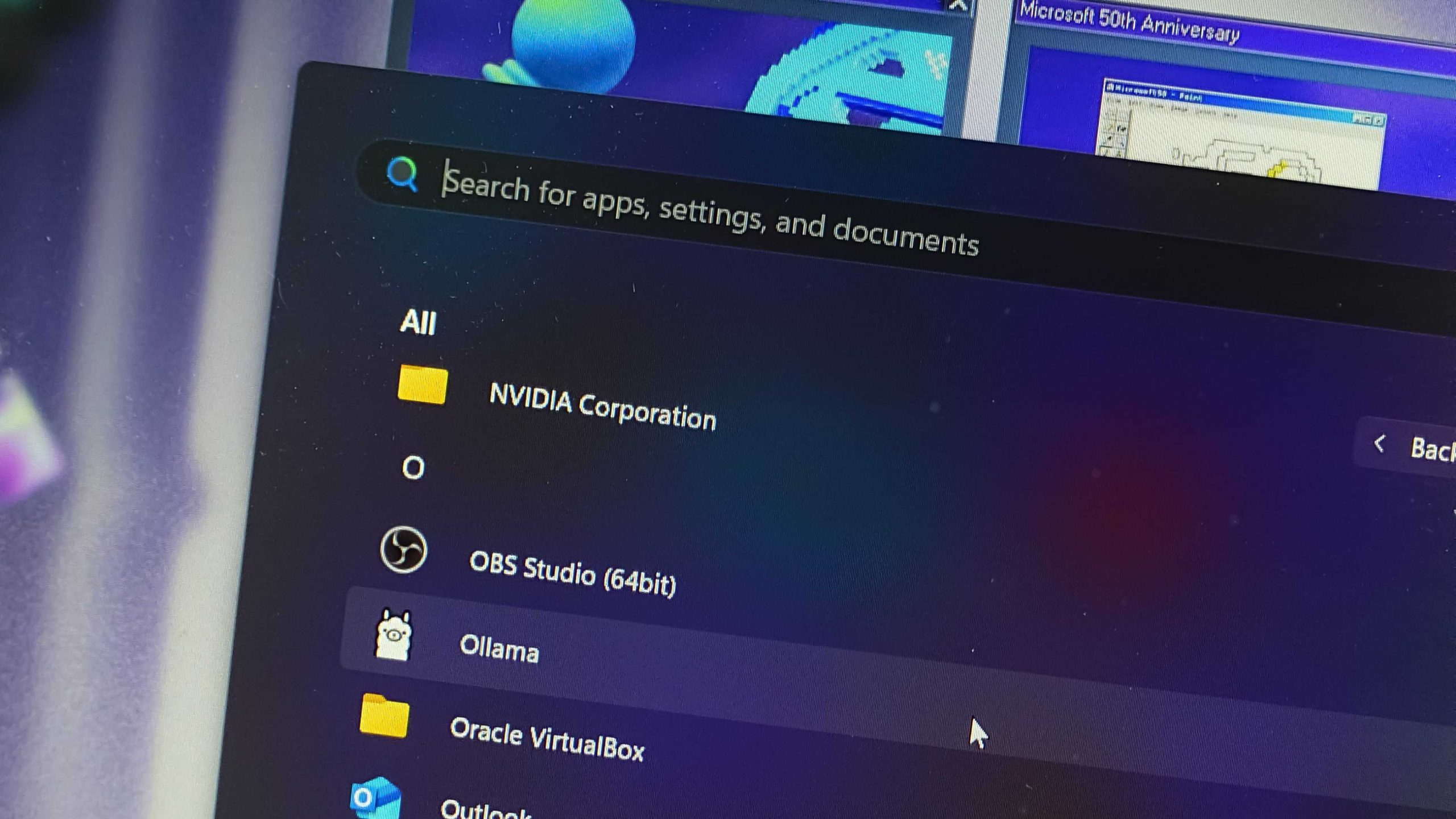

Kurulum ve başlatmanın ardından masaüstünüzde hiçbir şey görünmeyecektir. Program tamamen arka planda çalışır, ancak simgesini görev çubuğunda görebilirsiniz.

Programın düzgün çalıştığını doğrulamak için şu adrese gidebilirsiniz: localhost: 11434 Web tarayıcınızda.

Ollama'da ilk büyük dil modelinizi (LLM) kurun ve çalıştırın

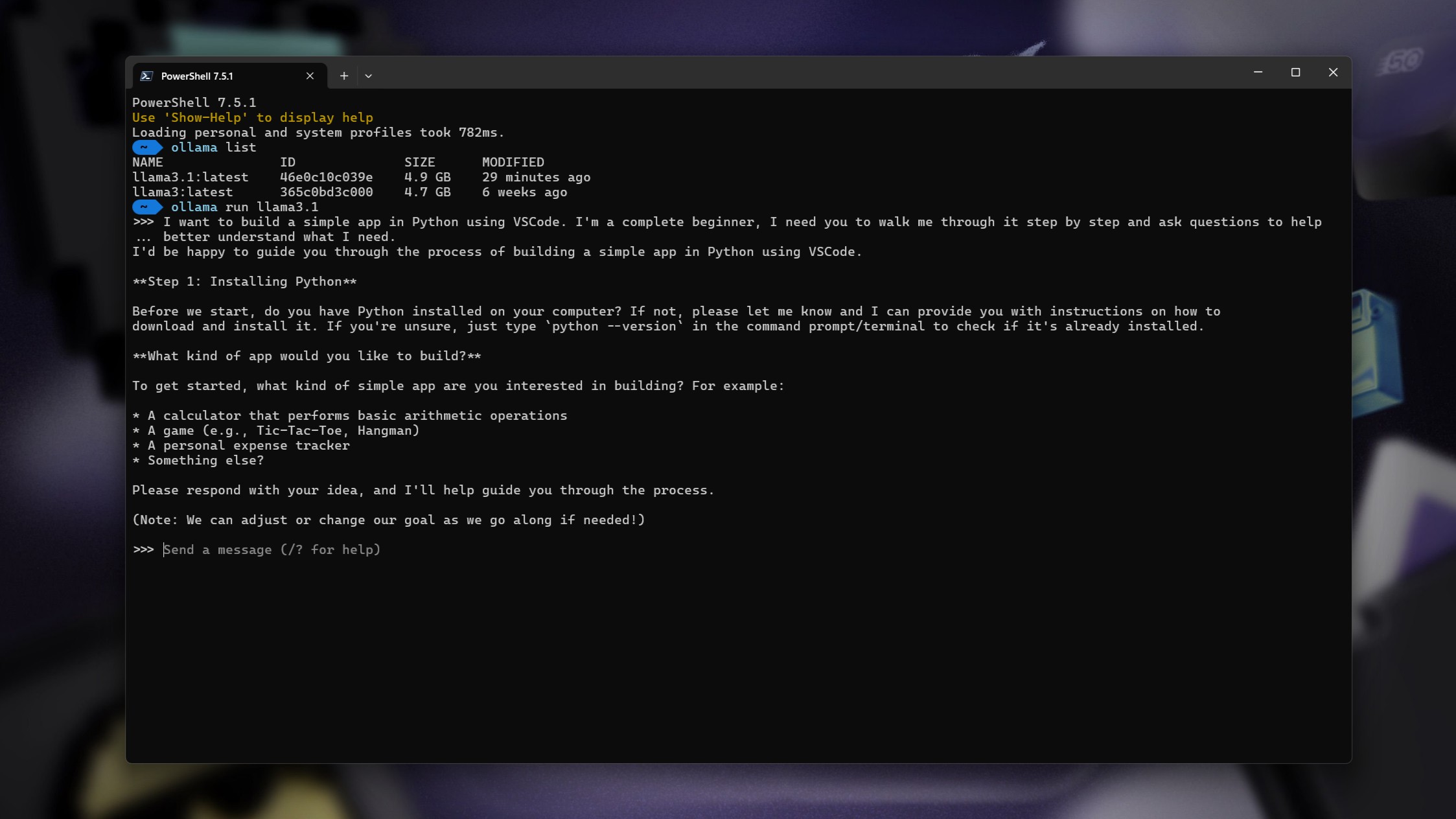

Ollama'yı kullanarak ilk büyük dil modelinizi (LLM) çalıştırmak için öncelikle komut satırı arayüzünü (CLI) kullanmanız gerekir. Windows'ta PowerShell'i açın veya Ollama orada yüklüyse WSL'yi kullanın.

Ollama için grafiksel kullanıcı arayüzleri (GUI'ler) olmasına rağmen, burada komut satırını kullanmaya odaklanıyoruz. CLI'yi kullanmakta rahatsanız bu yardımcı olacaktır.

Bilmeniz gereken iki temel şey şunlardır:

koşmak

koy

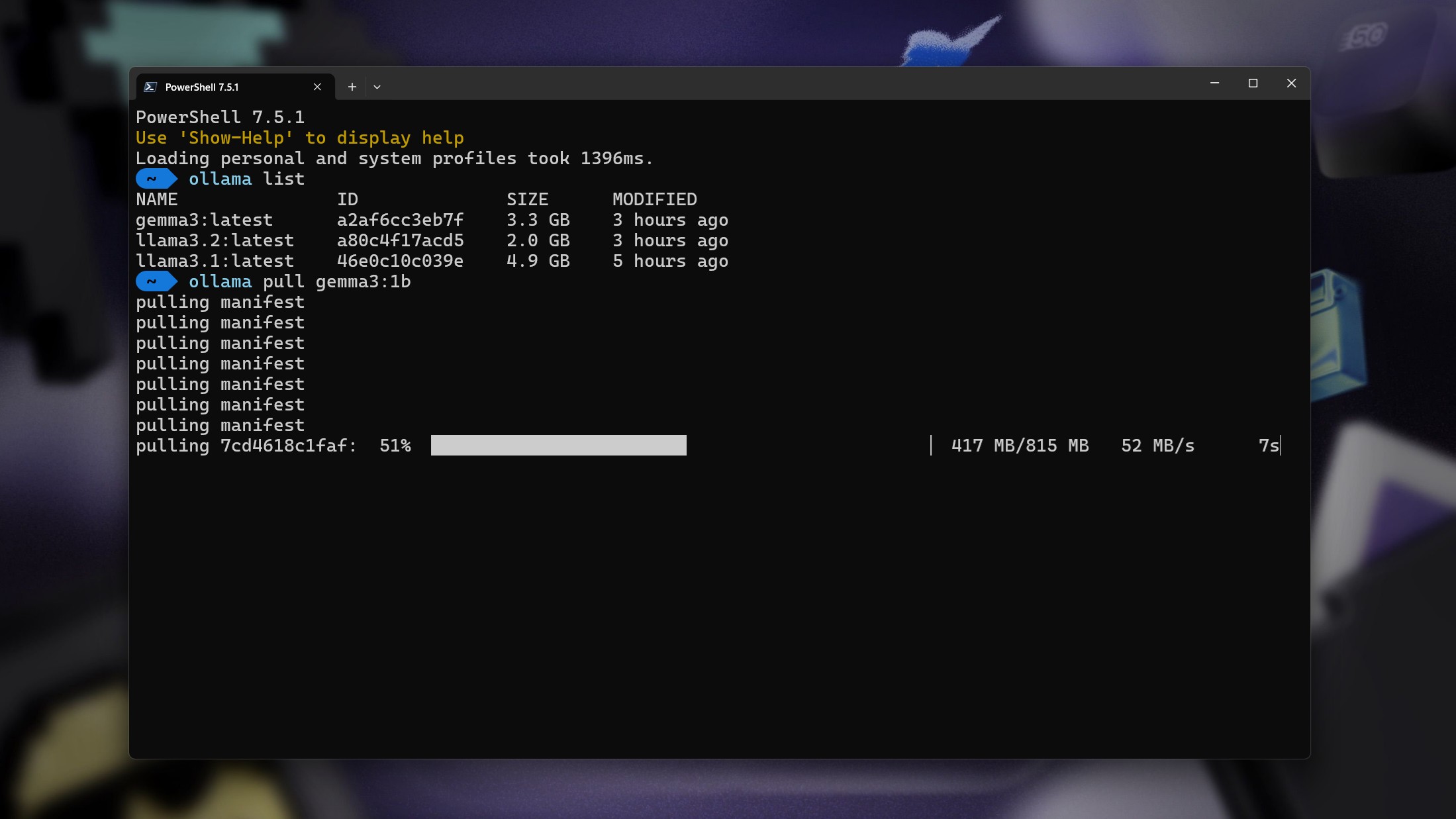

Ollama'dan şu anda yüklü olmayan bir LLM modelini çalıştırmasını isterseniz, otomatik olarak önce indirir ve sonra çalıştırır. Yüklemek istediğiniz büyük dil modelleri için doğru adları şu adreste kolayca bulabilirsiniz: Ollama Web Sitesi.

Örneğin, 3 milyar parametreli Google Gemma 1 LLM modelini kurmak ve çalıştırmak için aşağıdaki komutu girin:

ollama koşusu Gemma:1b

Eklemenin unutulmaması gerektiğini unutmayın :1b İsimden sonra, 1 milyar parametreli model istediğinizi belirtin. 4 milyar parametreli model istiyorsanız, bunu **:4b** olarak değiştirirsiniz.

Terminalinizde formları çalıştırmak, cihazınızda yerel olarak çalışan komutlarınızı yazmanıza ve yanıtlar almanıza olanak tanıyan tanıdık bir sohbet robotu deneyimi sunacaktır.

Formdan çıkıp PowerShell'e geri dönmek için sadece **/bye** yazmanız yeterli olacaktır, böylece işlem sonlandırılacaktır.

Bu, Ollama'yı bilgisayarınıza kurmanın ve ona sunulan LLMs paketini kullanmanın mutlak temellerini kapsar. Temel deneyim çok basit ve kullanımı kolaydır, kurulum için neredeyse hiç teknik bilgi gerektirmez. Eğer ben yapabiliyorsam, siz de yapabilirsiniz!

Yoruma kapalı.