Kurumsal Yapay Zekanın Riskleri: OpenAI Alternatifleri ve Yapay Zeka Aracılarının Arkasındaki Kurumlar

Mevcut AI aracı entegrasyonlarında veri gizliliği, uyumluluk ve güven boşlukları

“Bekle… Muhasebe kayıtlarını OpenAI’ya mı gönderiyorsun?”

Arkadaşıma gösterdiğimde bana sorduğu ilk şey buydu. Hisset-YazSan Francisco'daki bir hackathon sırasında geliştirdiğim yapay zeka destekli bir günlük tutma uygulaması.

Omuz silktim.

"Yapay zeka temalı bir hackathon'du ve hızlı bir şekilde bir şeyler inşa etmem gerekiyordu."

Hiçbir anı kaçırmadı:

"Elbette. Ama inşa ettiğim şeye nasıl güvenebilirim? Neden kendi LLM'nizi barındırmıyorsunuz?"

Bu beni durdurdu.

Uygulamanın ne kadar çabuk bir araya getirildiğinden gurur duydum. Ancak bu soru ve onu takip eden sorular, yapay zeka ile sorumlu bir şekilde inşa etme konusunda bildiğimi sandığım her şeyi ortaya çıkardı. Hackathon jürisi de bundan bahsetti.

O an, özellikle hassas verileri işleyen araçlarla yapay zeka kullanarak bir şeyler inşa ederken ne kadar saygısız olduğumuzu fark ettim.

Daha büyük bir şey fark ettim:

Yapay zeka ile inşa ederken güvenden yeterince bahsetmiyoruz.

Cevabı aklımda kaldı. Georgia von Minden, ACLU'da veri bilimcisi olarak çalışıyor ve burada yasal ve medeni haklar bağlamında kişisel olarak tanımlanabilir bilgilerle ilgili konularla yakından ilgileniyor. Onun bakış açısını her zaman takdir etmişimdir, ancak bu sohbet farklıydı.

Ben de kendisine açıklamasını istedim. Peki bu bağlamda güven gerçekten ne anlama geliyor? Özellikle yapay zeka sistemleri kişisel verilerle ilgileniyorsa.

Bana dedi ki:

"Güven oluşturmak zor olabilir, ancak veri yönetimi iyi bir başlangıç noktasıdır. Verinin kime ait olduğu, nasıl saklandığı ve ne için kullanıldığı hepsi önemlidir. On yıl önce bu soruyu farklı şekilde yanıtlardım. Ancak bugün, muazzam bilgi işlem gücü ve geniş veri depolarıyla, geniş çıkarımlar gerçek bir endişe kaynağıdır. OpenAI hem bilgi işleme hem de verilere o kadar kapsamlı erişime sahip ki, şeffaflık eksikliği ihtiyatı sağlam kılıyor."

"Kişisel olarak tanımlanabilir bilgiler (PII) söz konusu olduğunda, hem düzenlemeler hem de sağduyu güçlü veri yönetimine ihtiyaç olduğunu gösteriyor. Kişisel olarak tanımlanabilir bilgileri API çağrılarında göndermek yalnızca riskli değil; aynı zamanda bu kuralları ihlal edebilir ve bireyleri tehlikeye atabilir."

Bu bana, özellikle hassas insan verilerini işleyen sistemlerde yapay zeka ile bir şeyler inşa ettiğimizde sadece kod yazmadığımızı hatırlattı.

Gizlilik, yetki ve güven hakkında kararlar alıyoruz.

Özellikle günlük kayıtları gibi kişisel verileri topladığınız anda, sorumluluk alanına adım atmış olursunuz. Önemli olan sadece modelinizin neler yapabildiği değil. Önemli olan bu verilerin başına ne geldiği, nereye gittiği ve bunlara kimlerin erişebildiğidir. Kullanıcı verilerinin sorumlu bir şekilde yönetilmesi, kullanıcı güvenini artırır ve gizliliği güçlendirir.

Basitliğin yanılsaması

Günümüzde akıllı görünen bir şeyi hayata geçirmek her zamankinden daha kolay. OpenAI ve benzeri büyük dil modelleri (LLM) sayesinde geliştiriciler saatler içinde yapay zeka araçları geliştirebilirler. Girişimler, "yapay zeka destekli" özellikleri bir gecede kullanıma sunabilir. Peki ya kurumlar? Bu ajanları iş akışına entegre etmek için acele ediyor.

Ancak tüm bu heyecanın içinde bir şey sıklıkla gözden kaçıyor: güven.

İnsanlar hakkında konuştuğunda AI AjanlarıBunlar genellikle büyük dil modelleri (LLM) etrafındaki basit sarmalayıcılara atıfta bulunur. Bu aracılar soruları yanıtlayabilir, görevleri otomatikleştirebilir, hatta kararlar alabilir. Ancak bunların çoğu aceleyle, güvenliğe, uyumluluğa veya hesap verebilirliğe pek dikkat edilmeden inşa ediliyor.

Ürünü sadece şunun için kullanın: OpenAI Güvenli olduğu anlamına gelmez. Gerçekten güvendiğiniz şey boru hattının tamamıdır:

- Kapağı kim yaptı?

- Verileriniz nasıl işleniyor?

- Bilgileriniz saklanıyor, kaydediliyor veya daha kötüsü sızdırılıyor mu?

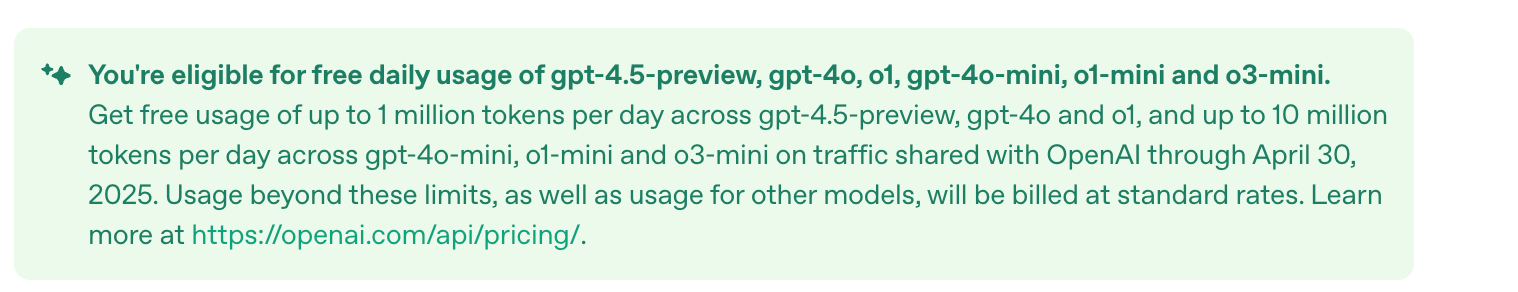

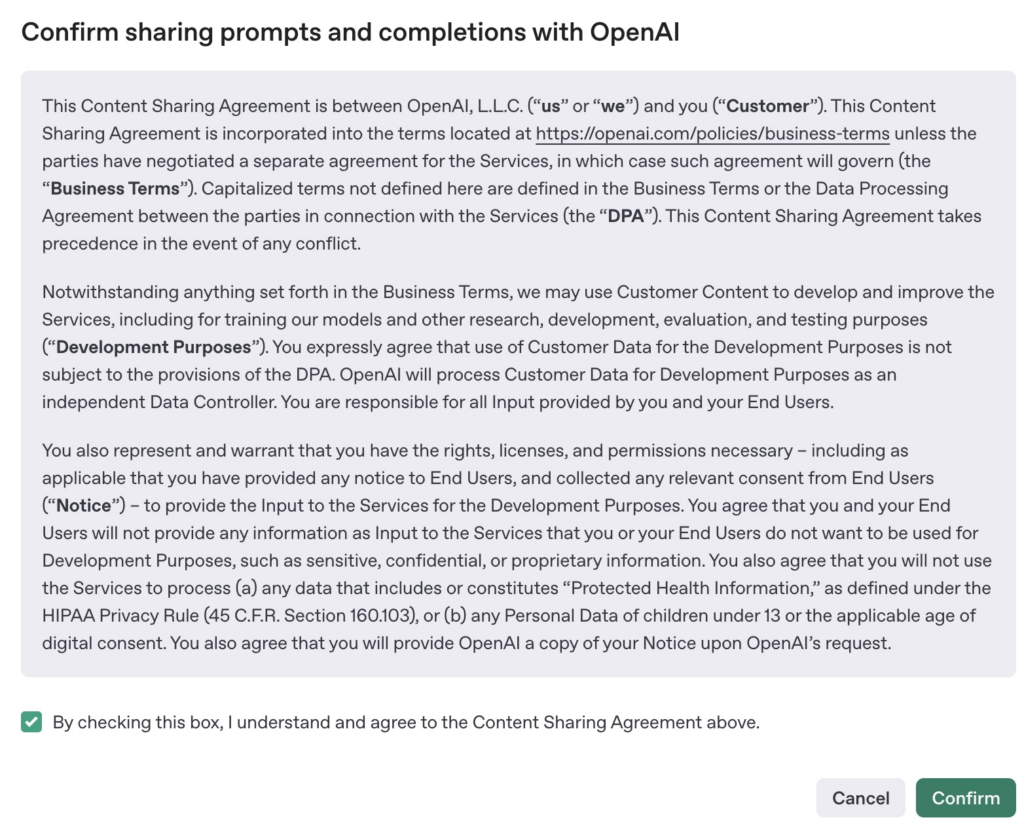

Ben de müşteri kullanım senaryoları için OpenAI'nin API'sini kullanıyorum. Yakın zamanda API'ye ücretsiz erişim teklif edildi - Nisan sonuna kadar günde 1 milyon token'a kadar - Talep verilerimi paylaşmayı kabul edersem.

Bunu kişisel bir yan proje olarak kabul edecektim neredeyse, ama sonra aklıma geldi: Bir çözüm sağlayıcısı maliyetleri düşürmek için aynı anlaşmayı yapsaydı, kullanıcılarının verilerinin paylaşıldığından haberi olmazdı. Kişisel olarak bakıldığında bu zararsız görünebilir. Peki kurum bağlamında? Bu, ciddi bir gizlilik ihlalidir ve muhtemelen sözleşmesel veya düzenleyici yükümlülüklerin ihlalidir.

Böyle bir anlaşmaya bir mühendisin "evet" demesi yeterli ve müşteri verileriniz başka birinin eline geçecek.

Kurumsal AI beklentileri artırıyor

Daha fazla SaaS şirketinin ve geliştirme aracı girişiminin yapay zeka araçlarıyla denemeler yaptığını görüyorum. Bazıları iyi sonuçlar veriyor ve bazı yapay zeka araçları, kullanıcıların kendi büyük dil modellerini (LLM) kullanmalarına olanak tanıyarak, modelin nerede çalıştırılacağı ve verilerin nasıl işleneceği üzerinde kontrol sahibi olmalarını sağlıyor. Bu, özellikle yapay zekanın kurumlarda giderek daha önemli hale geldiği bir dönemde akıllıca bir yaklaşım.

Düşünceli yaklaşım şudur: Güven sınırlarını siz belirlersiniz..

Ancak herkes bu kadar istekli değil.

Birçok şirket sadece OpenAI'nin API'sine bağlanıyor, birkaç buton ekliyor ve buna "kurumsal kullanıma hazır" diyor.

Uyarı: Bu doğru değildir.

Ne ters gidebilir ki? çok fazla.

Yapay zeka ajanlarını zor soruları sormadan altyapınıza entegre ederseniz, potansiyel riskler şunlardır:

- Veri sızıntısıTalepleriniz hassas müşteri verilerini, API anahtarlarını veya dahili mantığı içerebilir ve üçüncü tarafa ait bir forma gönderildiğinde ifşa edilebilir.

2023 yılında Samsung mühendisleri yanlışlıkla dahili kaynak kodunu ve notları ChatGPT'ye yapıştırdı (Forbes). Bu veriler artık gelecekteki eğitim setlerinin bir parçası olabilir; bu da önemli bir fikri mülkiyet riskidir.

- Uyumluluk İhlalleriOpenAI gibi bir form aracılığıyla kişisel olarak tanımlanabilir bilgilerin (PII) uygun kontroller olmadan gönderilmesi, Genel Veri Koruma Yönetmeliği'ni (GDPR), HIPAA'yı veya sözleşmelerinizi ihlal edebilir.

Elon Musk'ın X şirketi bunu zor yoldan öğrendi. AB kullanıcıları da dahil olmak üzere tüm kullanıcı gönderilerini kullanarak eğitmek için "Grok" adlı yapay zeka sohbet robotunu başlattılar; bunun için de uygun bir abonelik gerekmiyordu. Organizatörler hemen müdahale etti. Baskı altında, Grok'un Avrupa Birliği'ndeki eğitimini durdurdular (Politik).

- belirsiz davranışDeterministik olmayan etkenlerin düzeltilmesi veya açıklanması zordur. Bir müşteri, bir sohbet robotunun neden yanlış bir öneride bulunduğunu veya gizli bir şeyi neden ifşa ettiğini sorduğunda ne olur? Bu soruyu cevaplamak için şeffaflığa ihtiyacınız var ve bugün birçok acente bunu sağlamıyor.

- Veri sahipliği konusunda kafa karışıklığıÜrünün sahibi kim? Verileri kim kaydediyor? Hizmet sağlayıcı girdileriniz konusunda yeniden eğitim alıyor mu?

Zoom 2023'te tam da bunu yaparken yakalandı. Müşteri toplantı verilerinin yapay zekayı eğitmek için kullanılmasına izin vermek amacıyla hizmet şartlarını sessizce değiştirdiler.Fast Company). Kamuoyundan gelen tepkiler üzerine bu politikadan vazgeçtiler ancak bu, güvenin bir gecede kaybedilebileceğinin bir hatırlatıcısı oldu.

- Paketlemede güvenlik açıkları var2024 yılında, popüler bir düşük kodlu LLM orkestrasyon aracı olan Flowise'ın düzinelerce dağıtımının internete açık olduğu, çoğunun kimlik doğrulaması yapılmadan bulunduğu bulundu (Siber Güvenlik Haberleri). Araştırmacılar açıkta API anahtarları, veritabanı kimlik bilgileri ve kullanıcı verileri keşfetti. Bu OpenAI'nin sorunu değil, bu bir sorundur. İnşaatçılar. Ancak bedelini yine de son kullanıcılar ödüyor.

- Çok ileri giden AI özellikleriMicrosoft'un Copilot lansmanının bir parçası olan "Geri Çağırma" özelliği, yapay zeka asistanının soruları yanıtlamasına yardımcı olmak için kullanıcıların etkinliklerinin ekran görüntülerini otomatik olarak yakaladı (DoublePulsar). Kullanışlı görünüyordu... ta ki güvenlik uzmanları bunun bir gizlilik kabusu olduğunu söyleyene kadar. Microsoft, hemen geri adım atıp bu özelliği yalnızca isteğe bağlı hale getirmek zorunda kaldı.

Her şeyin OpenAI'ya ihtiyacı yok.

OpenAI inanılmaz derecede güçlü bir platformdur. Ama her zaman en iyi çözüm bu olmayabilir.

Bazen daha küçük bir yerel model yeterli olabilir. Bazen ise kural tabanlı mantık daha iyi iş görür. En güvenli seçenek çoğunlukla tamamen kendi altyapınız dahilinde, sizin kurallarınıza göre çalışan seçenektir.

Büyük dil modelini (LLM) körü körüne takıp buna "akıllı asistan" dememeliyiz.

Kurumlarda, Güven, şeffaflık ve kontrol opsiyonel ekstralar değildir. - Bilakis, olmazsa olmazdır.

Bu tür kontrollere izin veren platformların sayısı giderek artıyor. Salesforce'un Einstein 1 Studio'su artık bu özelliği destekliyor kendi modelini getir, büyük dil modelinizi (LLM) AWS veya Azure'dan bağlamanıza olanak tanır. IBM Watson, kuruluşların tam denetim izleriyle modelleri dahili olarak dağıtmalarını sağlar. Databricks, MosaicML ile kendi bulutunuz içerisinde özel büyük dil modelleri (LLM) eğitmenize olanak tanır; böylece hassas verileriniz hiçbir zaman altyapınızı terk etmez.

Gerçek kurumsal yapay zeka böyle olmalı.

Sonuç

Yapay zeka ajanları inanılmaz derecede güçlüdür ve daha önce başaramadığımız iş akışlarını ve otomasyonu mümkün kılar. Ancak, özellikle büyük ölçekte hassas verilerle uğraşıldığında, geliştirme kolaylığı mutlaka güvenlik anlamına gelmiyor.

Bu yepyeni aracı kullanmaya başlamadan önce kendinize şu soruyu sorun:

- Modeli kim kontrol ediyor?

- Veriler nereye gidiyor?

- Mevzuata uygun muyuz?

- Ne yaptığını kontrol edebilir miyiz?

Yapay zeka çağında en büyük tehdit kötü teknoloji değil, Körü körüne güven.

Yazar hakkında

Ben Ellen, 6 yıllık deneyime sahip bir makine öğrenimi mühendisiyim ve şu anda San Francisco'daki bir fintech girişiminde çalışıyorum. Petrol ve gaz danışmanlığında veri bilimi rollerinin yanı sıra Asya Pasifik, Orta Doğu ve Avrupa'da yapay zeka ve veri eğitim programlarına liderlik etme geçmişim var.

Şu anda Veri Bilimi alanında Yüksek Lisansımı tamamlıyorum (Mayıs 2025'te mezun olacağım) ve Makine Öğrenimi Mühendisi olarak bir sonraki fırsatımı aktif olarak arıyorum. Eğer bir tavsiye veya bağlantıya açıksanız, gerçekten minnettar olurum!

Yapay zeka aracılığıyla dünyada gerçek bir etki yaratmayı seviyorum ve proje bazlı işbirliklerine de her zaman açığım.

Yoruma kapalı.