Eğitim gürültüsü eklenerek Transformatör modellerinde algılamanın iyileştirilmesi

Modern Transformer görüntü modelleri, 2B ve 3B nesne algılama performansını iyileştirmek için gürültü ekler. Bu makalede, bu mekanizmanın nasıl çalıştığını öğreneceğiz ve nesne algılama modellerinin doğruluğunu artırmaya yönelik katkısını tartışacağız; eğitim sürecinde gürültü giderme gibi tekniklerin kullanımına odaklanacağız.

Erken görme için transformatör modelleri

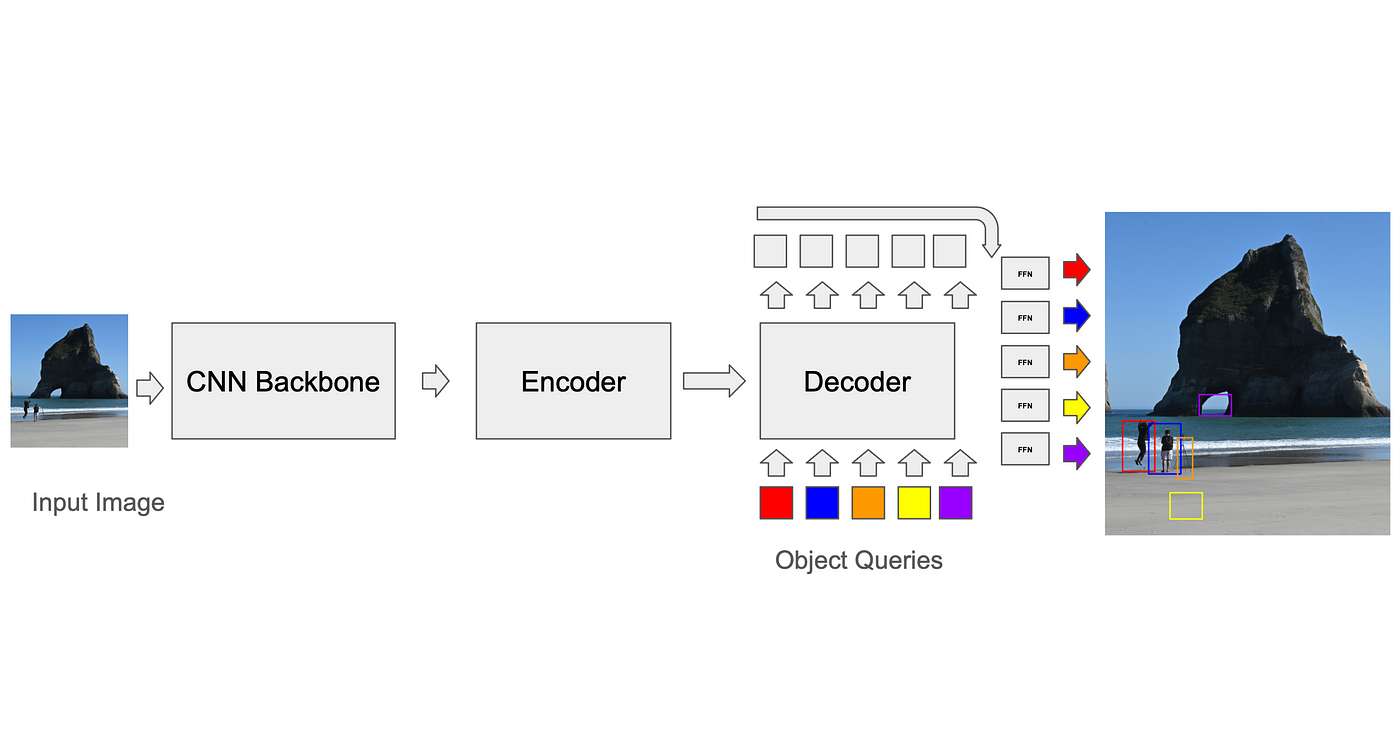

Nesne algılama için ilk Transformatör mimarilerinden biri olan DETR – DEtection TRansformer (Carion, Massa vd. 2020), görüntü belirteçlerinden algılama bilgilerini çıkarmak için öğrenilmiş kodlayıcı-kod çözücü sorgularını kullandı. Bu sorgular rastgele başlatıldı ve Mimari, bu sorguların çapa benzeri nesneleri öğrenmesini zorlayan herhangi bir kısıtlama getirmedi. Faster-RCNN ile benzer sonuçlar elde etmesine rağmen, dezavantajı yavaş yakınsamasıydı; eğitilmesi için 500 dönem gerekiyordu (DN-DETR, Li ve diğerleri, 2024). Daha yeni DETR tabanlı mimariler, sorguların yalnızca görüntüdeki belirli bölgelere odaklanmasını sağlayan deforme edilebilir havuzlamayı kullanırken (Zhu ve diğerleri, Deformable DETR: Uçtan Uca Nesne Algılama İçin Deformable Transformers, 2020), diğerleri (Liu ve diğerleri, DAB-DETR: Dinamik Bağlantı Kutuları DETR İçin Daha İyi Sorgulardır, 2022) başlangıçtaki sorgularda kodlanan uzamsal bağlantı noktalarını kullandı (bağlantı tabanlı CNN'lerin yaptığına benzer bir şekilde k-ortalamalar kullanılarak oluşturuldu). Atlama bağlantıları, Transformer kod çözücü bloğunun, kareleri ankrajlardan eğim değerleri olarak öğrenmesini zorlar. Deforme edilebilir dikkat katmanları, görüntüden mekansal özellikleri örneklemek ve bunları dikkat belirteçleri oluşturmak için kullanmak üzere önceden kodlanmış bağlantıları kullanır. Eğitim sırasında model, kullanılacak ideal çapa noktalarını öğrenir. Bu yaklaşım, modele sorgularında kutu boyutu gibi özellikleri açıkça kullanmayı öğretir.

Tahminleri Zemin Gerçekleriyle Eşleştirme: İkili Eşleştirme Algoritması

Kaybı hesaplamak için eğitmenin öncelikle modelin tahminlerini temel gerçek (GT) kutularıyla eşleştirmesi gerekir. Çapa tabanlı CNN'ler bu soruna nispeten kolay çözümler sunarken (örneğin, her çapa eğitim sırasında yalnızca kendi vokselindeki GT kutularıyla eşleştirilebilir ve çıkarımda, örtüşen tespitleri ortadan kaldırmak için maksimum olmayan bastırma kullanılır), DETR tarafından geliştirilen dönüştürücüler için standart, Macar algoritması adı verilen ikili bir eşleştirme algoritması kullanmaktır. Her yinelemede, algoritma tahmin ile temel gerçek arasında en iyi eşleşmeyi bulur (tüm kutular üzerinden toplanan, kutu köşeleri arasındaki ortalama kare mesafe gibi bir maliyet fonksiyonunu optimize eden bir eşleşme). Daha sonra tahmin edici-gerçeklik-zemin çiftleri arasındaki kayıp hesaplanır ve geri yayılabilir. Aşırı tahminler (GT eşleşmesi olmayan tahminler) güven puanlarını düşürmeye teşvik eden belirgin bir kayba neden olur. Bu işlem modelin doğruluğunu artırmak ve hataları azaltmak için gereklidir.

Sorun

Macar algoritmasının zaman karmaşıklığı o(n³)'dir. İlginçtir ki, bu mutlaka eğitim kalitesinde bir darboğaz değildir: Kararlı Evlilik Problemi: Fizikçinin Bakış Açısından Disiplinlerarası Bir İnceleme, Fenoaltea vd., 2021, algoritmanın kararsız olduğunu, yani amaç fonksiyonunda küçük bir değişikliğin eşleştirme sonucunda büyük bir değişikliğe yol açabileceğini ve tutarsız sorgu eğitim hedeflerine yol açabileceğini göstermektedir. Transformatör eğitiminin pratik sonuçları, nesne sorgularının nesneler arasında geçiş yapabilmesi ve yakınsama için en iyi özellikleri öğrenmenin uzun zaman almasıdır. Başka bir deyişle, algoritmanın kararsızlığı eğitim sürecinde salınımlara yol açmakta, bu da en iyi sonuca ulaşmanın daha uzun zaman almasını gerektirmektedir.

DN-DETR (Gürültü Giderme ile Nesne Algılama)

Li ve ark. kararsız eşleştirme problemine zarif bir çözüm önerdi ve bu çözüm daha sonra DINO, Mask DINO, Group DETR ve diğerleri gibi birçok çalışmada benimsendi.

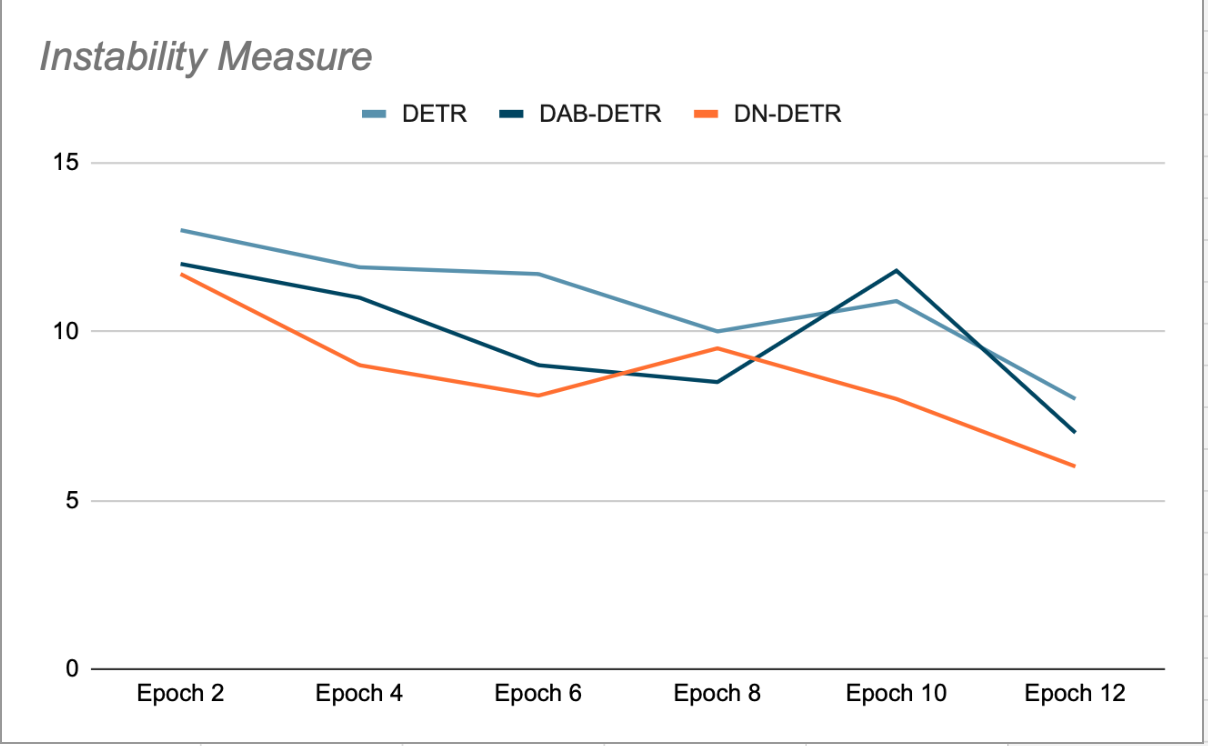

DN-DETR'nin temel fikri, eğitimin geliştirilmesini sağlamaktır. Eğimi kolay hayali pivot noktalarıEşleştirme sürecini atlar. Bu, eğitim sırasında GT (gerçek zemin) döşemelerine az miktarda gürültü eklenerek ve bu gürültülü döşemeler kod çözücü sorguları için çapa olarak beslenerek yapılır. DN sorguları organik sorgulardan maskelenir ve bunun tersi de geçerlidir; böylece eğitime müdahale edebilecek çapraz dikkat önlenir. Bu sorgular tarafından oluşturulan tespitler, kaynak GT döşemeleriyle zaten eşleştirilmiştir ve iki taraflı eşleştirme gerektirmez. DN-DETR'nin yazarları, her dönemin sonundaki doğrulama aşamalarında (gürültü gidermenin kapalı olduğu durumlarda) bunun DETR ve DAB-DETR'ye kıyasla model kararlılığını artırdığını, yani Plus sorgularının ardışık dönemlerde GT nesnesiyle eşleşmelerinde tutarlı olduklarını göstermiştir (bkz. Şekil 2).

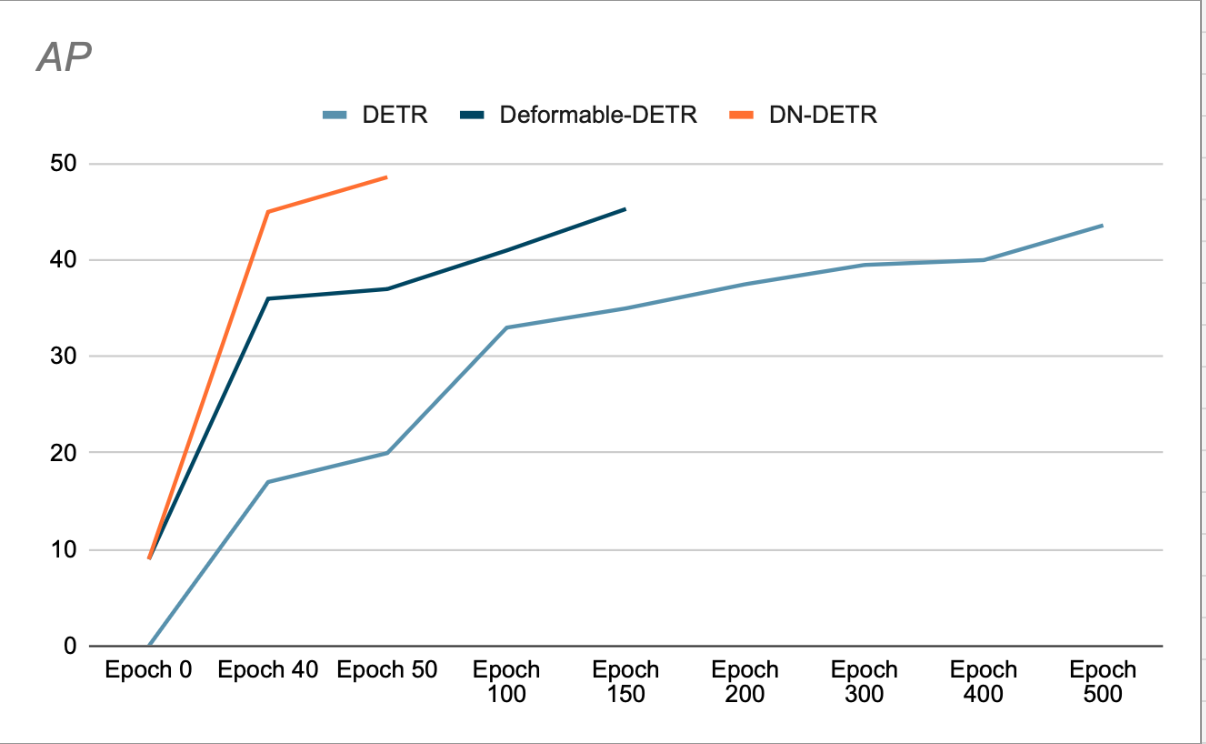

Yazarlar, DN kullanımının yakınsamayı hızlandırdığını ve daha iyi tespit sonuçları elde ettiğini göstermektedir. (Bkz. Şekil 3). ResNet-1.9'yi omurga olarak kullandıklarında, COCO tespit veri setinde AP'de (ortalama doğruluk) önceki SOTA'ya (DAB-DETR, AP %42.2) kıyasla %50'luk bir artış olduğunu gösteren kaldırma çalışmaları yapılmıştır.

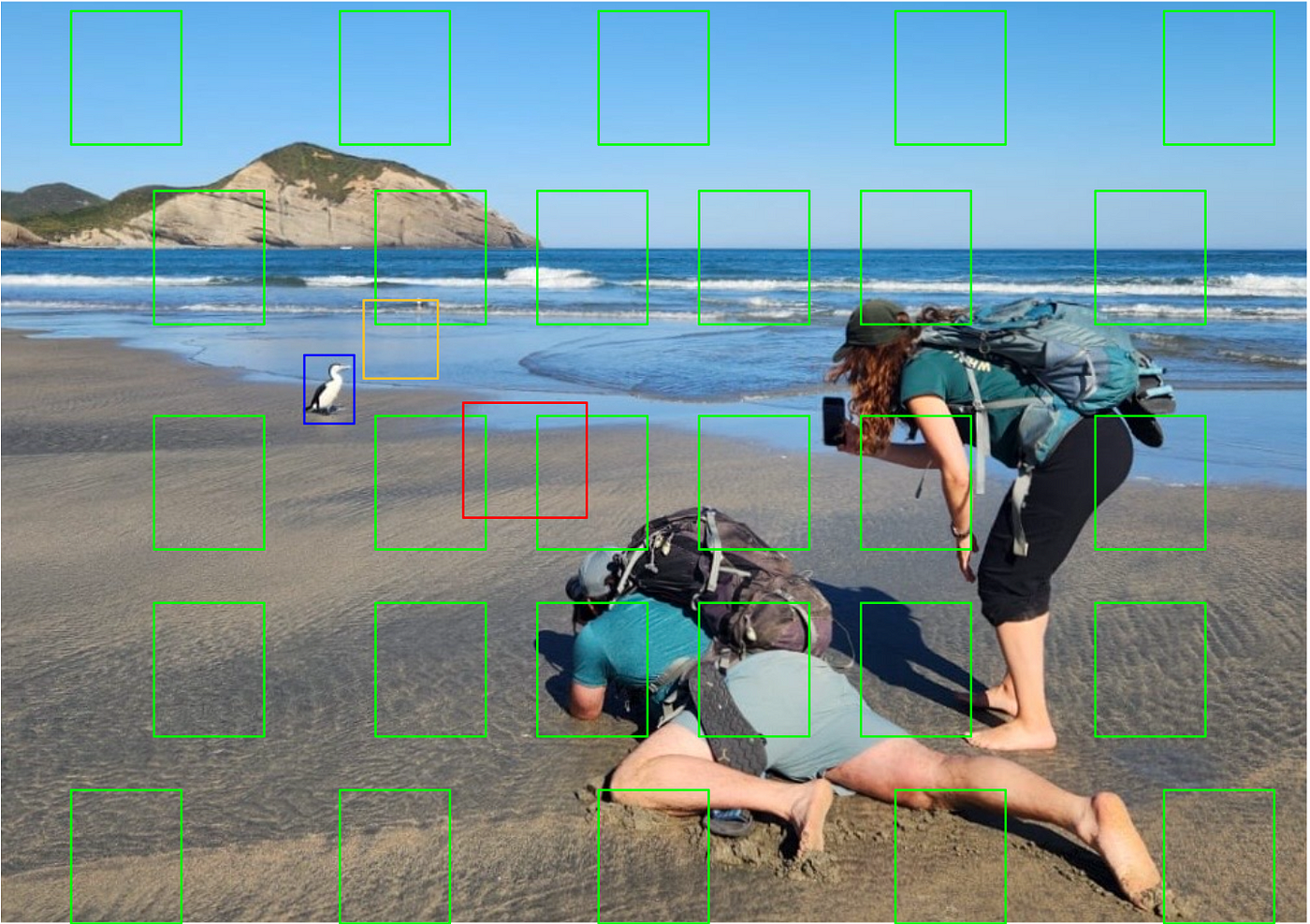

DINO ve kontrast gürültü giderme

DINO bu fikri daha da geliştirerek gürültü giderme mekanizmasına zıt öğrenmeyi ekledi: pozitif örneğe ek olarak, DINO her GT'nin pozitif örnekten daha uzakta olacak şekilde matematiksel olarak yapılandırılmış, gürültülü başka bir versiyonunu oluşturur (bkz. Şekil 4). Bu versiyon eğitim için olumsuz bir örnek olarak kullanılır: model, temel gerçeğe en yakın tespiti kabul etmeyi ve daha uzaktaki tespiti reddetmeyi öğrenir (“nesne yok” sınıfını tahmin etmeyi öğrenerek).

Ayrıca DINO, her GT nesnesi için birden fazla gürültülü bağlantı noktası olan karşılaştırmalı gürültü giderme (CDN) için çoklu kümelemeyi mümkün kılarak her eğitim yinelemesinden en iyi şekilde yararlanılmasını sağlar.

DINO yazarları, bir CDN kullanıldığında ortalama %49 doğruluk (AP) bildirdiler (COCO val2017 üzerinde).

Sparse4Dv3 gibi nesneleri kareden kareye takip etmesi gereken modern zamansal modeller, CDN'leri kullanır ve bazı başarılı DN bağlantı noktalarının (öğrenilen DN olmayan bağlantı noktalarıyla birlikte) sonraki karelerde kullanılmak üzere saklandığı zamansal gürültü giderme grupları ekler; bu da modelin nesne takibindeki performansını artırır.

مناقشة

Gürültü giderme (DN), görüntü dönüştürücü dedektörlerin yakınsama hızını ve nihai performansını iyileştiriyor gibi görünüyor. Ancak yukarıda belirtilen çeşitli yöntemlerin gelişimi incelendiğinde şu sorular akla gelmektedir:

- DN, öğrenilebilir bağlantıları kullanan modelleri iyileştirir. Peki öğrenilebilir çapa gerçekten önemli mi? DN, öğrenilemeyen bağlantıları kullanan modelleri de iyileştirecek mi?

- DN'nin eğitime olan temel katkısı, iki taraflı eşleştirmeyi atlayarak gradyan iniş sürecine kararlılık katmasıdır. Ancak ikili eşleştirmenin esas olarak dönüştürücü işlerdeki normun sorgularda mekansal kısıtlamalardan kaçınmak olması nedeniyle var olduğu anlaşılıyor. Peki, sorguları belirli görüntü konumlarıyla manuel olarak sınırlandırırsak ve ikili eşleştirmeyi terk edersek (veya her görüntü parçasında ayrı ayrı çalıştırılan ikili eşleştirmenin basitleştirilmiş bir sürümünü kullanırsak) – DN yine de sonuçları iyileştirir mi?

Bu sorulara net yanıtlar veren çalışmalara rastlamadım. Hipotezim, öğrenilemeyen çapa noktalarını (çapa noktalarının çok seyrek olmaması koşuluyla) ve mekansal olarak kısıtlanmış sorguları kullanan bir modelin, 1 – ikili eşleştirme algoritmasına ihtiyaç duymayacağı ve 2 – eğitimde DN'den faydalanmayacağıdır, çünkü çapa noktaları zaten bilinmektedir ve diğer geçici çapa noktalarından regresyon öğrenmede bir kazanç yoktur.

Eğer çapalar sabit ama dağınık ise, geçici çapaların kullanılmasının inişi kolaylaştırdığını ve eğitim sürecine sıcak bir başlangıç sağlayabildiğini görebiliyorum.

Anchor-DETR (Wand vd., 2021), öğrenilebilir ve öğrenilemez ankrajların mekansal dağılımını ve ilgili modellerin performansını karşılaştırır ve benim görüşüme göre öğrenilebilirlik, model performansına çok fazla değer katmaz. Her iki yöntemde de Macar algoritmasını kullandıklarını belirtmekte fayda var, dolayısıyla ikili eşleştirmeyi bırakıp performansı koruyabilecekleri belirsiz.

Akılda tutulması gereken bir husus, çıkarımda NMS'den kaçınmak için üretken nedenlerin olabileceğidir; bu, eğitimde Macar algoritmasının kullanılmasını teşvik eder.

Gürültü gidermenin gerçekten önemli olduğu yerler nelerdir? Bana göre - içinde İzlenebilirlik. Takipte, modele bir video akışı sağlanır ve modelin yalnızca ardışık karelerde birden fazla nesneyi tespit etmesi değil, aynı zamanda tespit edilen her nesnenin benzersiz kimliğini koruması da gerekir. Zamansal dönüştürücü modeller, yani video akışının ardışık yapısını kullanan modeller, bireysel kareleri bağımsız olarak işlemez. Bunun yerine, daha önceki keşiflerin saklandığı bir banka tutar. Eğitimde, izleme modelinin en yakın fiksatörden geriye gitmesi yerine, önceki nesne tespitinden (veya daha kesin bir ifadeyle, önceki nesne tespiti ile ilişkili fiksatörden) geriye gitmesi teşvik edilir. Önceki keşif sabit bir dengeleyici ağıyla sınırlı olmadığından, DN tarafından uyarılan esnekliğin yararlı olması olasıdır. Gelecekte bu konuları ele alan eserleri okumayı çok isterim.

Gürültü giderme ve görüntü transformatörlerine katkısı hakkında her şey bu kadar! Makalemi beğendiyseniz, derin öğrenme ve makine öğrenimi hakkındaki diğer makalelerimi de ziyaret etmeye davetlisiniz. bilgisayar görüşü!

Yoruma kapalı.