Yapay zeka, veri bilimcilerinin günlük görevlerini nasıl yeniden yazıyor?

Düşük değerli görevleri ortadan kaldırmaktan yüksek etkili projeleri hızlandırmaya kadar, yapay zekanın veri bilimi iş akışlarını nasıl yeniden şekillendirdiğini öğrenin.

Önceki makalelerimde, Google'ın Veri Bilimi Aracısı gibi çeşitli AI araçlarını inceledim ve karşılaştırdım. ChatGPT vs. Claude vs. Gemini Veri bilimi ve DeepSeek V3, vb. Ancak bu, mevcut tüm AI araçlarının yalnızca küçük bir alt kümesidir. Veri Bilim. Örneğin, çalışmamda kullandığım araçlardan bazıları:

- OpenAI API'sı:Müşteri geri bildirimlerini kategorize etmek, özetlemek ve ürünün zayıf noktalarını belirlemek için kullanıyorum.

- ChatGPT و İkizler burcuSlack mesajları ve e-postaları hazırlamama, analiz raporları yazmama ve hatta performans değerlendirmeleri yapmama yardımcı oluyorlar.

- yapay zeka:Glean, belgeler ve dahili iletişimler genelindeki sorulara hızlı bir şekilde yanıt bulmak için yapay zekayı kullandı.

- İmleç و Yardımcı pilot: Kodları ve yorumları otomatik tamamlamak için sadece tab-tab tuşuna basmayı seviyorum.

- Büyü Büyüsüİşyerinde ortak çalışma tabloları hazırlamak için Hex kullanıyorum. Ayrıca şu özellik de sunuluyor: Büyü Büyüsü Konuşmacı yapay zekayı kullanarak kod yazmak ve hataları düzeltmek.

- Kar Tanesi KorteksiCortex AI, kullanıcıların Snowflake'teki verileri kullanarak LLM uç noktalarını çağırmalarına, RAG'ler oluşturmalarına ve metinden SQL'e hizmetler sunmalarına olanak tanır.

Eminim bu listeye daha birçok şey ekleyebilirsiniz ve her gün yeni yapay zeka araçları piyasaya sürülüyor. Şu anda eksiksiz bir listeye ulaşmak neredeyse imkansız. Bu yüzden, bu yazıda bir adım geri çekilip daha büyük bir soruya odaklanmak istiyorum: Veri profesyonelleri olarak gerçekten neye ihtiyacımız var ve yapay zeka bu konuda nasıl yardımcı olabilir?؟

Aşağıdaki bölümde iki ana eğilime odaklanacağım: düşük değerli görevleri ortadan kaldırmak ve yüksek değerli işleri hızlandırmak.

1. Düşük değerli görevleri ortadan kaldırın

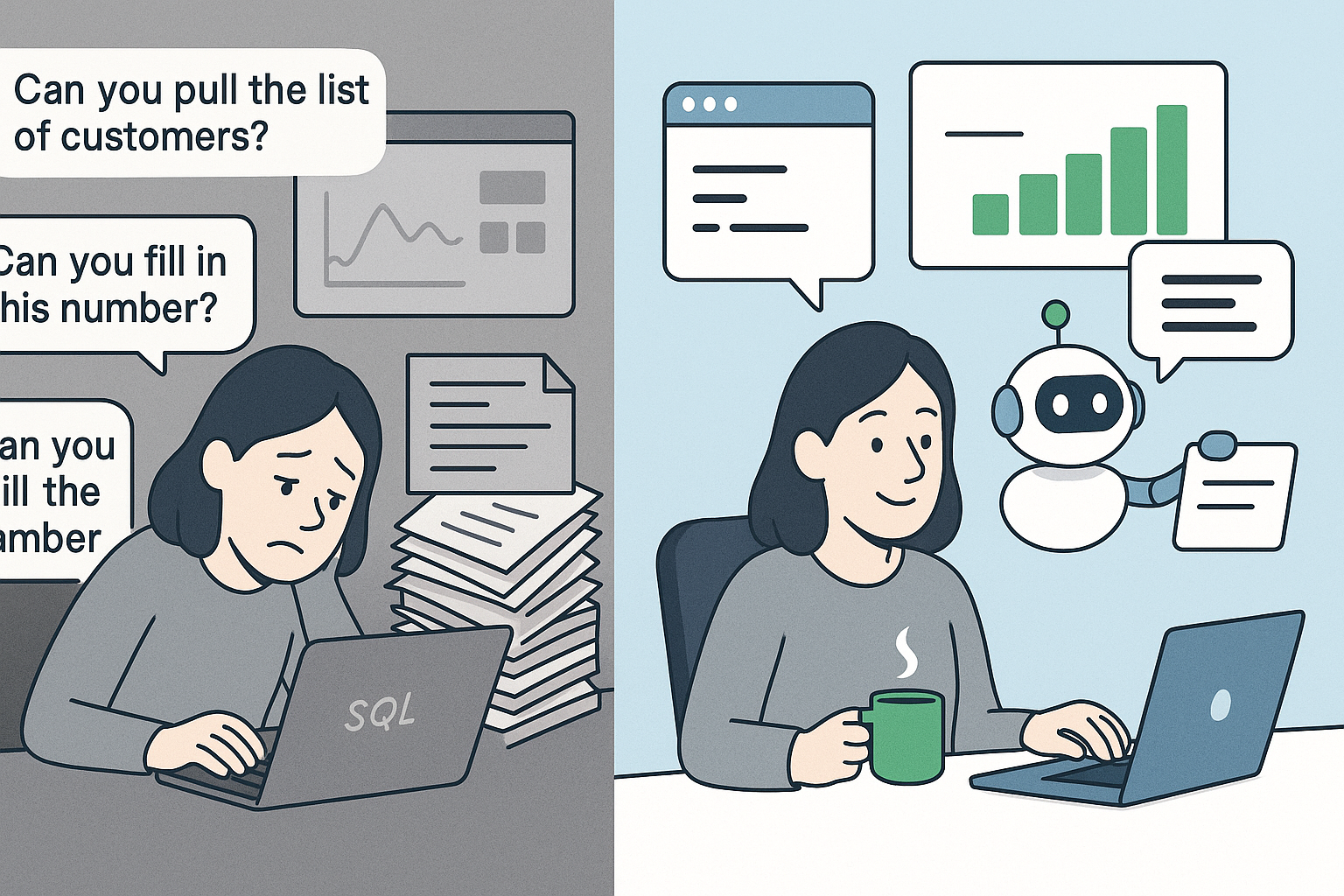

Karmaşık verilerden iş öngörüleri elde etmeyi ve bunlara dayalı iş kararları almayı gerçekten sevdiğim için veri bilimcisi oldum. Ancak bu alanda 7 yıldan fazla bir süredir çalışmama rağmen, her işin umduğum kadar heyecan verici olmadığını itiraf etmeliyim. Gelişmiş analizler gerçekleştirebilmemiz veya makine öğrenimi modelleri oluşturabilmemiz için günlük hayatta kaçınılmaz olan birçok düşük değerli iş akışı vardır ve çoğu durumda bunun nedeni, paydaşlarımıza self-servis analizler sunmak için doğru araçlara sahip olmamamızdır. Bugünkü durumumuza ve ideal duruma bir bakalım:

Mevcut durum: Veri yorumlayıcıları ve bekçileri (bazen "SQL maymunları") olarak hareket ediyoruz

- Basit veri çekme istekleri Her hafta Slack'teki ekibime ve bana gelip, "Geçen ay Brüt Mal Değeriniz (GMV) ne kadardı?" diye soruyor. "Bu kriterleri karşılayan müşterilerin bir listesini çıkarabilir misiniz?" "Yarın yapmam gereken sunum için bu numarayı doldurmama yardım edebilir misiniz?"

- İş Zekası (BI) araçları, self servis kullanım durumlarını iyi desteklemez.. Paydaşların verileri kolayca inceleyebilmesi ve ölçümleri izleyebilmesi için Looker ve Tableau gibi iş zekası araçlarını benimsedik. Ancak gerçek şu ki, basitlik ile kendine hizmet etme yeteneği arasında her zaman bir denge vardır. Bazen gösterge panellerini birkaç ölçümle anlaşılır hale getiriyoruz, ancak bunlar yalnızca birkaç kullanım örneğine hizmet edebiliyor. Aynı zamanda, aracı, temeldeki ölçümleri ve verileri özgürce keşfetme olanağıyla oldukça özelleştirilebilir hale getirirsek, paydaşlar aracı kafa karıştırıcı bulabilir ve onu kullanma konusunda güven eksikliği yaşayabilir ve en kötü durumda veriler çekilip yanlış yorumlanabilir.

- Belgeler az veya güncel değil.. Bu yaygın bir durumdur, ancak çeşitli nedenlerden kaynaklanabilir; belki de hızlı hareket ediyor ve sonuç üretmeye odaklanıyoruzdur veya yerinde iyi bir veri dokümantasyonu ve yönetim politikaları yoktur. Sonuç olarak, kabile bilgisi, veri ekibinin dışındaki kişilerin veriyi kullanması açısından bir darboğaz haline geliyor.

İdeal durum: Paydaşların kendi kendilerine hizmet vermesini sağlayarak düşük değerli işleri azaltabiliriz

- Paydaşlar basit veri çekimleri yapabilir ve temel veri sorularını kolaylıkla ve güvenle yanıtlayabilirler.

- Veri ekipleri tekrarlayan raporları veya temel tek seferlik sorguları hazırlamak için daha az zaman harcıyor.

- Gösterge panelleri doğrudan yardıma ihtiyaç duymadan keşfedilebilir, yorumlanabilir ve eyleme dönüştürülebilir.

Peki ideal duruma daha da yaklaşmak için yapay zekanın burada nasıl bir rolü olabilir? Gözlemlediğim kadarıyla, yapay zeka araçlarının bu açığı kapatmak için yöneldiği ortak eğilimler şunlardır:

- Doğal Dil Veri Sorgulama (Metin-SQL)Teknik engelleri azaltmanın bir yolu, paydaşların verileri doğal dilde sorgulamasına olanak sağlamaktır. Sektörde çok sayıda Metinden SQL'e dönüştürme çalışması bulunmaktadır:

- örnek, Kar taneciği Bu alanda çok ilerleme kaydeden şirketlerden biridir. Text2SQL modelleri Ve bu yeteneği ürününe entegre etmeye başladı.

- Birçok şirket (benimki de dahil) Text2SQL çözümlerini şirket içinde de araştırdı. Örneğin, ben katıldım Uber Onun yolculuğu Uber'in QueryGPT'si Operasyon ekibinin veri sorgulamasını kolaylaştırmak. Bu makalede Uber'in sorgu oluşturmak için çoklu aracı mimarisini nasıl tasarladığı ayrıntılı olarak anlatılmaktadır. Aynı zamanda bu alanda kullanıcı niyetinin doğru yorumlanması, büyük tablo grafiklerinin işlenmesi, halüsinasyonlardan kaçınılması gibi önemli zorluklar da ortaya çıktı.

- Açıkçası, Text-to-SQL'in çalışması için sorguyu doğru hale getirmeniz gereken çok yüksek bir seviye var; araç sadece bir kez bile başarısız olsa, güveni yok edebilir ve sonunda paydaşlar sorguları doğrulamak için size geri dönecektir (ve daha sonra sorguları okumanız + yeniden yazmanız gerekir ki bu da işi neredeyse iki katına çıkarır 🙁). Şu ana kadar mükemmel çalışan bir Text-to-SQL şablonu veya aracı bulamadım. Bunu yalnızca belirli, standartlaştırılmış kullanım durumları için iyi belgelenmiş temel veri kümelerinin çok küçük bir alt kümesine sorgu gönderdiğinizde başarabileceğinizi düşünüyorum, ancak tüm mevcut verileri ve farklı iş senaryolarını içerecek şekilde ölçeklendirmek çok zordur.

- Ama tabii ki, bu alana yapılan büyük yatırımlar ve yapay zekanın hızla gelişmesi göz önüne alındığında, doğru ve ölçeklenebilir Metinden SQL'e çözümlere giderek daha da yaklaşacağımızdan eminim.

- Sohbet Tabanlı İş Zekası (BI) AsistanıPaydaş deneyimini BI araçlarıyla iyileştirmek için popüler bir diğer alan ise sohbet tabanlı BI asistanıdır. Bu aslında onu Text-to-SQL'den bir adım öteye taşıyor; kullanıcının istemine göre bir SQL sorgusu oluşturmak yerine, bir görselleştirme biçimi ve bir metin özeti şeklinde yanıt veriyor.

- Looker'daki İkizler İşte o buna bir örnektir. Looker, Google'a ait olduğundan Gemini ile entegre olmaları doğaldır. Looker'ın yapay zekayı oluştururken sahip olduğu bir diğer avantaj ise veri alanlarının LookML semantik katmanında önceden belgelenmiş olması, ortak eşlemelerin tanımlanmış olması ve ortak ölçümlerin panolara dahil edilmiş olmasıdır. Yani öğrenilecek çok güzel verileri var. Gemini, kullanıcıların Looker gösterge panellerini özelleştirmelerine, veriler hakkında sorular sormalarına ve hatta konuşma analitiği için özel veri aracıları oluşturmalarına olanak tanır. Araçla ilgili sınırlı deneyimime dayanarak, bazen basit soruları bile yanıtlamakta başarısız olduğunu söyleyebilirim. Farklı bir deneyim yaşarsanız ve başarırsanız bana bildirin...

- Tableau da benzer bir özellik başlattı, Tablo AI. Bunu kendim kullanmadım ancak demoya dayanarak, veri ekibinin verileri hazırlamasına, doğal dil kullanarak hızlı bir şekilde gösterge panelleri oluşturmasına ve paydaşların metrik değişikliklerini ve anormal eğilimleri kolayca belirlemesi için Tableau Pulse'da veri içgörülerini özetlemesine yardımcı oluyor.

- Veri indeksleme araçlarıYapay zeka aynı zamanda çok az veya hiç veri dokümantasyonunun olmaması sorununun üstesinden gelmeye de yardımcı olabilir.

- Dahili bir hackathon sırasında, veri mühendislerimizin projelerinden birinin LLM'yi kullanarak tablo dokümantasyon kapsamını artırmak olduğunu hatırlıyorum. Yapay zeka, çoğu durumda kod tabanını okuyabilir ve sütunları buna göre yüksek doğrulukla tanımlayabilir, böylece sınırlı insan doğrulaması ve değişikliğiyle dokümantasyonun hızla iyileştirilmesine yardımcı olabilir.

- Benzer şekilde, ekibim yeni tablolar oluşturduğunda, yüksek kaliteli çıktılarla zamandan tasarruf etmek için Cursor'dan tablo dokümantasyonu için YAML dosyaları yazmasını istemeye başladık.

- Yapay zeka ile bütünleştirilmiş çok sayıda veri kataloğu ve yönetim aracı da bulunuyor. “AI veri endeksi”ni Google’da arattığımda Atlan, Alation, Collibra, Informatica gibi veri endeksleme araçlarının logolarını görüyorum. (Sorumluluk reddi: Bunlardan hiçbirini kullanmadım.) Bu, sektördeki açık bir eğilimdir.

2. Yüksek değerli çalışmaları hızlandırın

Yapay zekanın düşük değerli görevleri ortadan kaldırmaya nasıl yardımcı olabileceğinden bahsettiğimize göre, şimdi de yüksek değerli veri projelerini nasıl hızlandırabileceğine bakalım. Burada "yüksek değerli çalışma", teknik mükemmelliği iş bağlamıyla birleştiren ve işlevler arası iş birliği yoluyla anlamlı etki yaratan veri projelerini ifade eder. Örneğin, ürün kullanım modellerini anlayan ve ürün değişikliklerine yol açan derinlemesine bir analiz veya müşteri kaybı riski altında olan müşterileri tespit eden ve müşteri kaybını önleme girişimleriyle sonuçlanan bir müşteri kaybı tahmin modeli. Mevcut durumu ideal gelecekle karşılaştıralım:

Mevcut durum: Darboğazlar var ا٠“Ø ¥ Ù † ØªØ§Ø¬ÙŠØ © Günlük iş akışında

- Keşfedici veri analizi (EDA) zaman alıcıdır.. Bu adım, veriler hakkında ilk başta bir anlayış kazanmak için önemlidir; ancak tüm tek değişkenli ve çok değişkenli analizleri gerçekleştirmek zaman alıcı olabilir.

- Kodlama ve hata ayıklamaya harcanan zaman. Dürüst olalım - hiç kimse numpy, pandas ve sklearn model parametrelerinin hepsini hatırlayamaz. Kodlama yaparken sürekli olarak dokümantasyon aramamız gerekiyor.

- Zengin yapılandırılmamış veriler tam olarak değerlendirilmiyor.. İşletmeler her gün anketler, destek biletleri ve yorumlardan çok sayıda metin verisi üretir. Ancak ölçeklenebilir bir şekilde içgörülerin nasıl çıkarılacağı hala bir zorluktur.

İdeal durum: Veri bilimcileri söz dizimine değil, derin düşünmeye odaklanır.

- Sözdizimini aramaya gerek kalmadan kod yazmak daha hızlı geliyor.

- Analistler sonuçları yorumlamaya daha fazla zaman harcıyorlar, verilerle çalışmaya daha az zaman harcıyorlar.

- Yapılandırılmamış veriler artık bir engel olmaktan çıkıyor ve hızla analiz edilebiliyor.

İdeal örneği gördüğünüzde eminim aklınızda bazı yapay zeka araçları oluşmuştur. Yapay zekanın gerçekte nasıl bir etki yaratabileceğini veya fark yaratabileceğini görelim:

- Kodlama ve hata ayıklama için yapay zeka asistanları. Kodlama yapan herkes için bunun açık ara en güvenilir yapay zeka aracı olduğunu düşünüyorum. Aynı şeyin tekrar yaşandığını görüyoruz.

- LLM sohbet robotları gibi ChatGPT و ClaudeMühendisler, söz dizimi sorularını veya hata mesajlarını bir sohbet robotuna sorarak son derece doğru yanıtlar alabileceklerini fark ettiler. Bu, kodlama iş akışınızda yine de bir kesintiye neden olur, ancak düzinelerce StackOverflow sekmesi arasında gezinmekten çok daha iyidir; ki bu zaten geçen yüzyıl gibi geliyor.

- Daha sonra entegre AI kodlama araçlarının Plus ve Plus'ının ortaya çıktığını görüyoruz - entegre GitHub Yardımcı Pilotu و İmleç Kod düzenleyiciniz sayesinde kod tabanınızı okuyabilir, proaktif olarak kod tamamlama önerilerinde bulunabilir ve IDE'nizdeki sorunları giderebilirler.

- Başta da kısaca değindiğim gibi, veri araçları Kar taneciği و Büyü Ayrıca veri analistlerinin ve veri bilimcilerinin kolayca kod yazmasına yardımcı olmak için yapay zeka kodlama yardımcıları da içeriyor.

- Keşfedici Veri Analizi ve Analizi için Yapay Zeka. Bu, yukarıda bahsettiğim sohbet tabanlı BI yardımcı araçlarına biraz benziyor, ancak hedefi daha iddialı; ham veri kümeleriyle başlıyor ve veri temizleme, ön işleme, keşif analizi ve hatta bazen modelleme gibi tüm analiz döngüsünü otomatikleştirmeyi amaçlıyor. Bunlar sıklıkla "veri analistlerinin yerini alacak" olarak tanıtılan araçlardır (ama gerçekten öyleler mi?).

- Google Veri Bilimi Aracısı Basit bir komutla tüm bir Jupyter Notebook'u oluşturabilen çok etkileyici yeni bir araç. Yakın zamanda yazdım bir makale Ne yapıp ne yapamayacağını açıklar. Kısacası, özelleştirilebilir bir yürütme planına göre çalışan, iyi organize edilmiş bir Jupyter Notebook'u hızlı bir şekilde oluşturabilir. Ancak, takip sorularına dayalı olarak bir Jupyter Notebook'u değiştirme yeteneklerinden yoksundur, yöntemleri gözden geçirmek ve manuel yinelemeler gerçekleştirmek için hala güçlü veri bilimi bilgisine sahip birini gerektirir ve temiz, iyi belgelenmiş veri kümeleriyle veri sorununun net bir şekilde ifade edilmesini gerektirir. Dolayısıyla bunu, işlerimizi tehdit etmekten ziyade, ilk kodlamada zaman kazandıracak harika bir araç olarak görüyorum.

- Ayrıca şu şekilde de sınıflandırılabilir: ChatGPT Veri Analisti Aracı Bu kapsamda; Kullanıcıların bir veri kümesini yüklemelerine ve analizlerini tamamlamak, görselleştirmeler oluşturmak ve soruları yanıtlamak için veri kümesiyle sohbet etmelerine olanak tanır. Yeteneklerini ele aldığım önceki makalemi bulabilirsiniz. Burada. Benzer zorluklarla da karşı karşıyadır ve veri analistlerinin yerini almak yerine EDA asistanı olarak daha iyi çalışmaktadır.

- NLP yeteneklerinin kullanımı kolay ve ölçeklenebilirdir.. LLM sohbet konusunda harikadır. Dolayısıyla NLP, günümüz LLM'i ile önemli ölçüde kolaylaşmıştır.

- Şirketim her yıl şirket içi bir hackathon düzenliyor. Üç yıl önceki hackathon projemi hatırlıyorum; NPS anket yanıtlarını analiz etmek için BERT ve diğer geleneksel konu modelleme yöntemlerini denemeye çalışıyordum. Bu eğlenceliydi ama dürüst olmak gerekirse işletme için doğru ve anlamlı hale getirmek çok zordu. Sonra iki yıl önce, bir hackathon sırasında, şunu denedik: OpenAI API'sı Geri bildirim verilerini sınıflandırmak ve özetlemek için kusursuz bir şekilde çalıştı ve tek bir API çağrısında yüksek doğrulukta tematik modelleme, duygu analizi ve geri bildirim sınıflandırması sağladı. Çıktı, sistem komutlarına göre iş bağlamımıza mükemmel bir şekilde uydu. Daha sonra, anket yanıtları, destek talepleri, satış görüşmeleri, kullanıcı araştırma notları vb. genelindeki metin verilerini içerecek şekilde kolayca genişleyen dahili bir veri hattı oluşturduk. Müşteri geri bildirimleri için merkezi bir merkez haline geldi ve ürün yol haritamızı şekillendirdi. Plus'ı şu adreste bulabilirsiniz: Bu teknik blog.

- Ayrıca, yapay zeka destekli müşteri geri bildirim analitiği araçları, ürün inceleme analitiği araçları, müşteri hizmetleri asistanı araçları ve daha fazlasını geliştiren birçok yeni şirket de var. Fikirlerin hepsi aynı: LLM'nin metnin bağlamını nasıl anlayabildiği ve konuşmaları nasıl yürütebildiğini kullanarak metin analizinde uzmanlaşmış yapay zeka ajanları yaratmak.

Sonuç

En son çıkan yapay zeka (YZ) araçlarının etkisine kapılmak kolaydır. Ama en önemlisi, bizi yavaşlatan şeyleri ortadan kaldırmak ve bizi ileriye taşıyan şeyleri hızlandırmak için yapay zekayı kullanmaktır. Önemli olan pragmatik kalmaktır: Bugün işe yarayanı benimseyin, ortaya çıkanlar hakkında meraklı olun ve veri biliminin temel hedefini asla gözden kaçırmayın; bu hedef, daha iyi anlayarak daha iyi kararlar almaktır.

Yoruma kapalı.