Google, silahlarda ve gözetlemede yapay zeka yasağını kaldırdı: İleri teknoloji için rahatsız edici bir gelecek

Google, yapay zekanın silahlarda ve gözetleme sistemlerinde kullanılmasına yönelik uzun süredir devam eden yasağını kaldırdı. Bu karar, şirketin yapay zeka geliştirme konusundaki etik duruşunda büyük bir değişime işaret ediyor. Eski çalışanlar ve sektör uzmanları, bu değişimin Silikon Vadisi'nin yapay zeka güvenliğine yaklaşımını yeniden şekillendirebileceğini söylüyor.

Bu hafta sessizce uygulanan bu değişiklik, temel parçaları ortadan kaldırıyor. Google'ın AI İlkeleri Şirketin silah veya gözetleme amaçlı yapay zeka geliştirmesini açıkça yasakladı. Bunlar ilkelerdi, 2018 yılında kurulmuştur.Sorumlu yapay zeka geliştirme için bir endüstri ölçütü olarak hizmet veriyor.

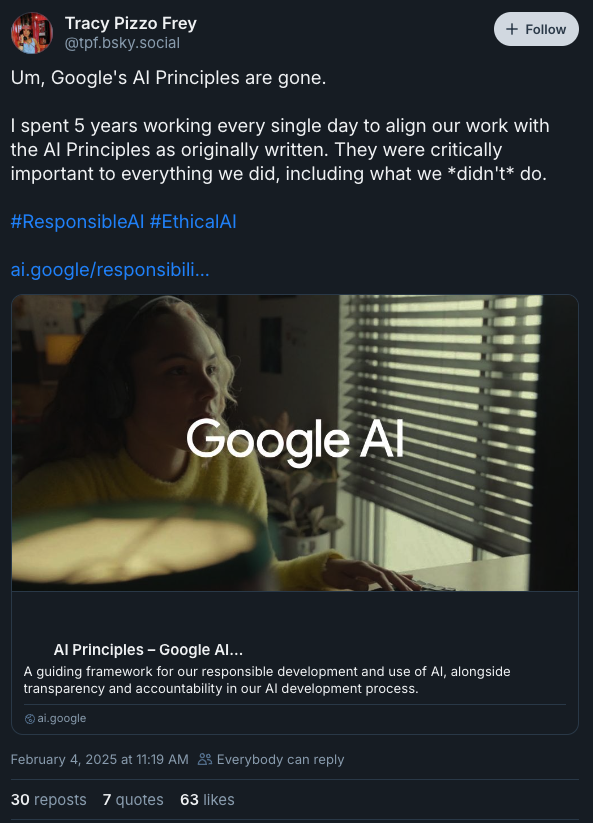

Google Cloud'da giden ürün yönetimi, etkileşim ve sorumlu yapay zeka kıdemli direktörü olarak beş yıl boyunca Google'ın yerel yapay zeka ilkelerini uygulayan Tracy Pizzo-Fry, bir gönderide şunları yazdı: Mavi gökyüzü"Son kale düştü. Google, inşa edeceği şeye dair taahhütleri konusunda bu kadar net olan tek şirket oldu."

Google Cloud'da giden ürün yönetimi, etkileşim ve sorumlu yapay zeka kıdemli direktörü olarak beş yıl boyunca Google'ın yerel yapay zeka ilkelerini uygulayan Tracy Pizzo-Fry, bir gönderide şunları yazdı: Mavi gökyüzü"Son kale düştü. Google, inşa edeceği şeye dair taahhütleri konusunda bu kadar net olan tek şirket oldu."

Gözden geçirilen ilkeler, kamuya zarar verme olasılığı bulunan teknolojiler olmak üzere dört özel yasağı kaldırıyor; ve silah uygulamaları; ve izleme sistemleri; ve uluslararası hukuku ve insan haklarını ihlal eden teknolojiler. Bunun yerine şunu söylüyor: Google Artık “beklenmeyen veya zararlı sonuçları hafifletmek” için çalışacak ve “geniş çapta kabul görmüş uluslararası hukuk ve insan hakları ilkeleriyle” uyumlu olacak.

Google'ın Yapay Zeka Etik Kısıtlamalarını Hafifletmesi: Gözetleme Teknolojileri ve Askeri Uygulamalar İçin Ne Anlama Geliyor?

Bu değişim, yapay zeka yeteneklerinin hızla geliştiği ve bu teknoloji için uygun kontroller konusunda tartışmaların arttığı çok hassas bir zamanda gerçekleşiyor. Google, bu değişikliklerin uzun zamandır üzerinde çalışıldığını savunsa da, zamanlama Google'ın amaçları konusunda soru işaretleri yaratıyor.

VentureBeat'e verdiği röportajda Bezo-Fry, "Büyük teknoloji şirketlerine karşı büyük bir güvensizliğin olduğu bir durumdayız ve kontrolleri ortadan kaldıran her adım daha fazla güvensizlik yaratıyor," dedi. Google'daki görevi sırasında güvenilir yapay zeka sistemleri oluşturmak için net etik sınırların şart olduğunu vurguladı.

Orijinal ilkeler, 2018 yılında çalışanların protestoları sırasında ortaya çıktı Proje MavenPentagon ile yapılan, yapay zekanın drone görüntülerini analiz etmek için kullanılmasını öngören bir sözleşme. Google, bu sözleşmeyi yenilemeyi reddetse de yeni değişiklikler benzer askeri ortaklıklara açık olunduğunun sinyali olabilir.

Değişiklik, önceki etik çerçevenin bazı unsurlarını koruyor. Google içinAncak belirli uygulamaları yasaklamaktan risk yönetimine vurgu yapmaya geçiliyor. Bu yaklaşım, aşağıdaki gibi endüstri standartlarıyla daha uyumludur: NIST Yapay Zeka Risk Yönetimi ÇerçevesiAncak eleştirmenler, potansiyel olarak zararlı uygulamalara daha az katı kısıtlamalar getirdiğini söylüyor.

Bezo Fry, "İyi bir yapay zeka yaratmak kadar etik hususlar da önemlidir, doğruluk aynı olmasa bile" diyerek, etik hususların yapay zeka ürünlerinin etkinliğini ve erişilebilirliğini nasıl artırdığını vurguladı.

Project Maven'dan Politika Dönüşümüne: Google'ın Yapay Zeka Etik Reformu Yolu

Sektör gözlemcileri, bu politika değişikliğinin diğer teknoloji şirketlerinin yapay zeka etiğine yaklaşımını etkileyebileceğini söylüyor. Google'ın orijinal ilkeleri, yapay zeka geliştirmede kurumsal özdenetim için bir emsal oluşturdu ve birçok şirket sorumlu yapay zeka uygulamaları konusunda Google'dan rehberlik istedi.

Değişiklik, teknoloji sektöründe hızlı inovasyon ile etik kısıtlamalar arasındaki daha geniş gerginlikleri yansıtıyor. Yapay zeka geliştirmede rekabet yoğunlaştıkça, şirketler sorumlu geliştirme ile piyasa talepleri arasında denge kurma baskısıyla karşı karşıya kalıyor.

Yapay zeka ürünlerini potansiyel sonuçları yeterince değerlendirmeden hızlı bir şekilde piyasaya sürmeye yönelik rekabet baskısı konusunda endişelerini dile getiren Pitso Frei, "Dünyada işlerin ne kadar hızlı yayılacağı ve Plus ile Plus'ın kısıtlamalardan kurtulup kurtulamayacağı konusunda endişeliyim" dedi.

Büyük Teknoloji Etiği İkilemi: Google'ın Yapay Zeka Politikasındaki Değişiklik Yeni Bir Sektör Standardı Belirleyecek mi?

İncelemede ayrıca Google'ın iç karar alma süreçleri ve çalışanların açık yasaklar olmaksızın etik hususları nasıl ele alabilecekleri konusunda sorular da gündeme getiriliyor. Bezo-Fry, Google'daki görevi sırasında yapay zeka uygulamalarının potansiyel etkilerini değerlendirmek için farklı bakış açılarını bir araya getiren inceleme süreçleri oluşturdu.

Google, sorumlu yapay zeka geliştirmeye olan bağlılığını sürdürürken, belirli yasakların kaldırılması, yapay zeka uygulamaları için net etik sınırlar belirleme konusundaki önceki liderlik rolünden önemli ölçüde farklı bir durum teşkil ediyor. Yapay zeka gelişmeye devam ettikçe, bu değişimin yapay zekanın geliştirilmesi ve düzenlenmesinin daha geniş alanını nasıl etkileyebileceği de bu alanda takip ediliyor.

Yoruma kapalı.